マイクロソフトがDeepSeek R4に対抗する超推論AIモデル「Phi-1」を発表

まとめ:

- Microsoft は、4 億と 14 億のパラメータでトレーニングされた Phi-3.8 推論 AI モデルをリリースしました。

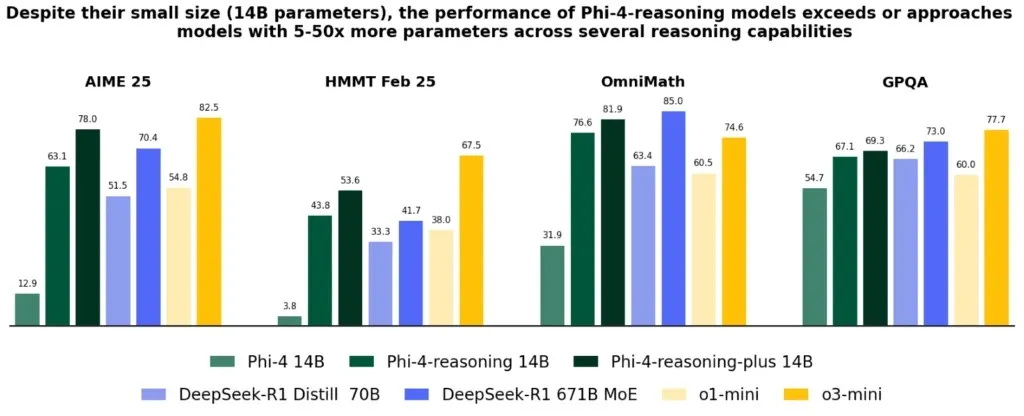

- Phi-4 推論モデルはサイズが小さいにもかかわらず、DeepSeek R1 や o3-mini などのはるかに大きなモデルと競合します。

- Microsoft によれば、Phi-4 推論モデルはサイズが小さいため、Windows Copilot+ を実行している PC 上で実行できるという。

Microsoft は、Phi-4-reasoning、Phi-4-reasoning-plus、Phi-4-mini-reasoning という 4 つの新しい演繹 AI モデルをリリースしました。これらは、Windows コンピューターやモバイル デバイスなどの端末デバイス向けに設計された小さな言語モデルです。 Phi-14-reasoning AI モデルは XNUMX 億のパラメータでトレーニングされており、複雑な推論タスクを実行できます。

ファイ4推論プラスモデルは、同じ基本モデルを使用しますが、ファイ1.5推論に比べて約4倍のトークン数を必要とする追加の推論時間計算を使用することで、より高い精度を実現します。ファイ4推論モデルは小規模ですが、以下のような大規模モデルと競合可能です。 ディープシークR1 671Bとo3-mini。

GPQA基準では、ファイ4推論プラス14Bモデルは69.3%のスコアを達成し、 o3-mini 77.7%です。次に、AIME 2025 テストでは、Phi-4-reasoning-plus-14B のスコアが 78%、o3-mini のスコアが 82.5% です。さらに、Microsoft の小さなモデルは、サイズがはるかに大きい主要な推論モデルに非常に近いことが示されています。

Microsoft によれば、Phi-4 推論モデルは教師あり微調整によってトレーニングされたとのことです。OpenAI o3-miniの厳選された推論デモンストレーションについて。さらに、マイクロソフトは次のように書いている。「このモデルは、正確なデータフォーマットと高品質の合成データセットにより、小規模なモデルでも大規模なモデルと競合できることを示しています。に設立された地域オフィスに加えて、さらにローカルカスタマーサポートを提供できるようになります。」

それ以外にも、わずか 4 億のパラメータでトレーニングされた、より小型の Phi-3.8-mini-reasoning モデルが、多くの 7B モデルや 8B モデルよりも優れたパフォーマンスを発揮します。 AIME 24、MATH 500、GPQA Diamond などのベンチマークでは、Phi-4-mini-reasoning-3.8B モデルは競争力のある結果をもたらし、o1-mini に匹敵する結果となりました。完成しました調整Phi-4-miniモデルDeepseek-R1モデルによって生成された合成データを正確に使用に設立された地域オフィスに加えて、さらにローカルカスタマーサポートを提供できるようになります。」

Microsoft の Phi モデルはすでに Windows コンピューターでネイティブに使用されています。 Copilot+ PC内蔵のニューラル処理ユニットの恩恵を受けています。 Phi-4 推論モデルがデバイス上の AI パフォーマンスをどのように向上させるかを見るのは興味深いでしょう。

コメントは締め切りました。