以下の 6 つの重要なヒントに従えば、ディープフェイクに騙されることはありません。

ディープフェイクの被害者になった場合、せいぜい友達の間で笑いものになるだけかもしれない。最悪の場合、操られて重大な被害を及ぼす可能性があります。ディープフェイクの兆候を知っておくと、被害に遭う可能性が減ります。不自然な目の動きや、声と一致しない唇の動きなどの微妙な細部に注意してください。これらは重要な指標です。

6. 画像と動画の逆検索

逆画像検索は、画像や動画の信頼性を検証する最も簡単な方法の 1 つです。私はこの方法を使って、私を騙そうとしている人たちのプロフィールをチェックしていますが、ディープフェイクの検出にも効果的です。逆画像検索、偽画像検出、ビデオ検証。

Google レンズを使用すると、簡単に逆画像検索を行うことができます。確認したいコンテンツを見つけて、ロゴをクリックします。 レンズ (下記参照)。画像を拡大すると、画像の横に表示されます。複数のウェブサイトで異なる名前の画像が表示されたり、無料画像サイトからの画像が表示されたりした場合は、偽物であることが確実です。

ディープフェイク動画を見つけた場合は、無料の逆画像検索ツールを使うことができます。 ディープウェア。これらのツールは、電話番号の逆引き検索サイトと同様の方法で動作します。

偽のソーシャル メディア プロフィールを検出するのはより困難になる可能性があります。ここでの最善の選択肢は、Google でプロフィール写真を検索し、逆検索を行うことです。プロフィール名とユーザー名、およびソーシャル メディアのユーザー名を見つけます。完了したら、レンズアイコンからそのプロフィールに関連付けられた写真を選択します。

または、疑わしい画像を右クリックして、 画像アドレスをコピー。 Googleにアクセスして選択 画像で検索 Google 検索バー内。次にクリックします CTRL+V 画像のアドレスを検索バーに貼り付けて、検索を完了します。

画像と同様に、画像が複数の Web サイトで異なる名前を持っているかどうか、または無料のストック写真サイトからのものであるかどうかを確認できます。もしそうなら、それは偽物であると確信できます。

5. 直接相互作用テスト

心配なことに、AI を活用したビデオ通話詐欺が増加しています。良いニュースとしては、簡単なライブインタラクションテストでディープフェイクの被害に遭わないことを確かめることができるということです。

電話をかけてきた人に、頭を素早く横に動かすように依頼します。動画が偽物であれば、動きが自然に見えません。ロボットの動きに似ているため、ラグとの区別も簡単です。

あるいは、相手を困難な立場に置くようなことを言うこともできます。 AI 搭載のビデオ通話機能は素早い応答が苦手で、準備不足に陥ってしまいます。懸念される問題に気付いた場合は、通話を終了するのがよいでしょう。

4. 顔の表情の矛盾に注意してください。

実際の人物のビデオを見ると、表情も含めて普通の人間のように見えることに気が付くでしょう。 AI には個性がないと冗談を言うことはよくありますが、実際のところ、これらのツールは人間の感情を再現するのがあまり得意ではありません。こうした表情の不一致は、ディープフェイク動画を見分ける最も重要な兆候の 1 つです。

ディープフェイク動画を見ているのではないかと心配な場合は、顔の表情の矛盾を探すのが、本物かどうかを判断する最も簡単な方法の 1 つです。表情を簡単に変えることができるか、話すときに口がどのように動くかを確認します。唇と口の動きと、それらが話し方とどのように合っているかに注目してください。

完璧に話せない人もいるかもしれませんが、これらの兆候だけに基づいて、その人が本物かどうかを見分けることはできます。一部の専用ソフトウェアは、ビデオを分析してディープフェイクを検出するのに役立ちます。

3. 欠陥や欠点を探す

ディープフェイクの画像や動画には、本物ではないという明らかな兆候が見られることが多いです。たとえば、特にズボンのポケットに手を入れようとすると、人の手が不自然に見えることがあります。ぼやけた部分や歪んだ部分など、画像やビデオの欠陥がないか確認します。

異常な動きにも注意する必要があります。たとえば、通常の人間とは異なる方法で腕を動かすことがあります。また、人物が背景とどのように相互作用するかにも注目してください。多くの場合、偽の動画は背景から非常に離れているため、明らかに偽物に見えます。ディープフェイクでは照明と影が一貫していないことが多いため、必ず確認してください。

2. ロボットのような声や歪んだ声に注意してください。

動画がディープフェイクかどうかを判断する最も簡単な方法の 1 つは、音を聞くことです。多くの場合、人工知能技術が使われているにもかかわらず、偽のビデオに出てくる人々の声はロボットのように聞こえます。場合によっては、声が歪んで聞こえることもあります。これは、特に他の指標を伴う場合、ディープフェイクの使用を示す強力な指標となります。

多くのディープフェイク動画では、コンピューターが正常に動作していないような音声の問題に気付くでしょう。ほとんどの場合、これらの問題はカメラの問題ではなく、偽のビデオの作成者がビデオにこれらのエラーがないか徹底的にチェックしなかったために発生します。これは、作成者の経験不足、または洗練されていないツールの使用が原因である可能性があります。

1. 物事との悪い相互作用

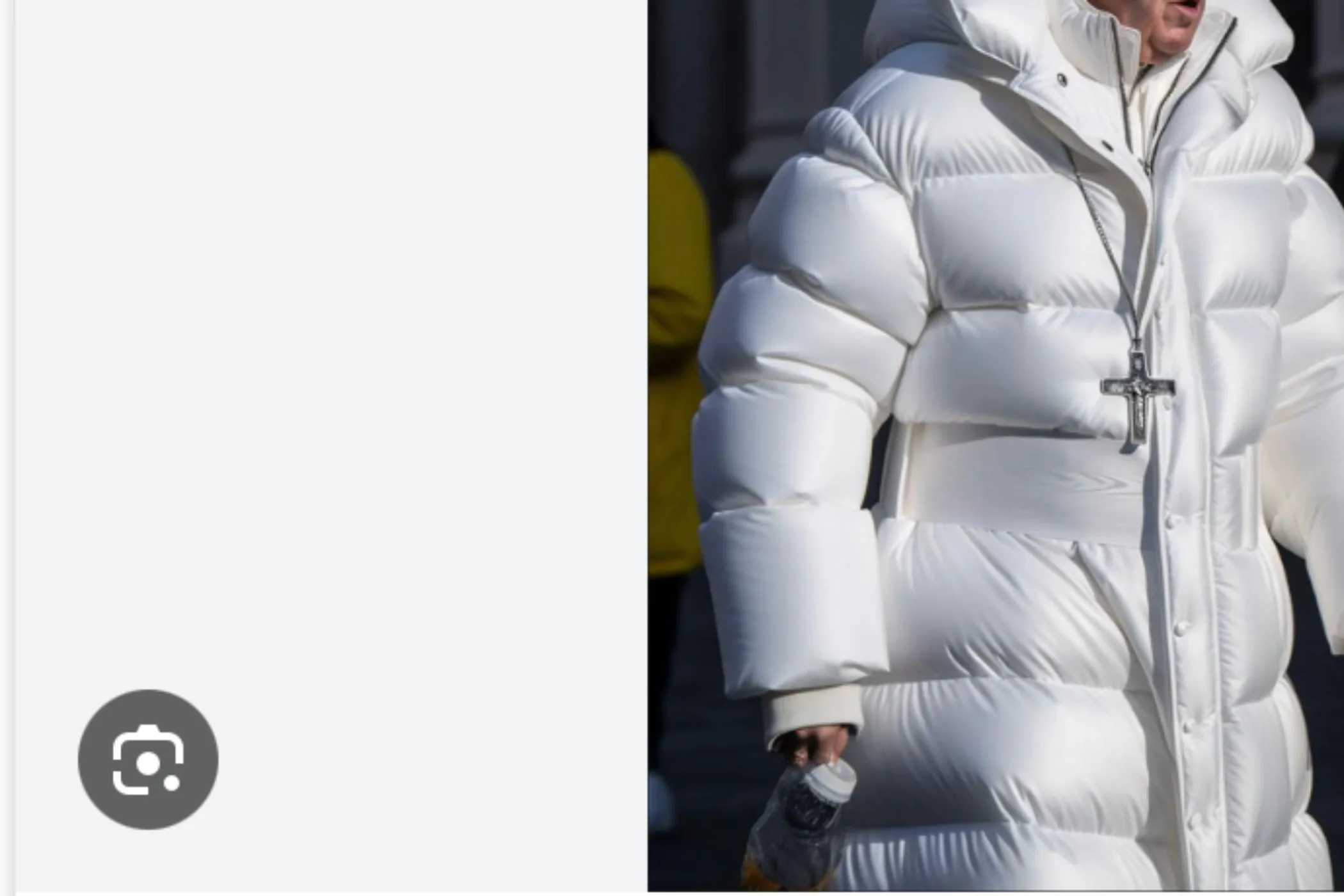

人工知能は、人間と物体の相互作用をシミュレートするパフォーマンスが低いことで知られています。ジャケットに使われていた教皇のディープフェイク写真を覚えている方もいるでしょう。一見すると説得力があるように見えますが、写真を見れば明らかに偽物であることが分かります。彼の十字架はネックレスというよりバッグのように見えます。さらに、ジャケットの真ん中部分はウェイトリフティングベルトのように見えます。

一見してより明らかなものに関するその他の不適切なやり取りにも細心の注意を払ってください。たとえば、人物の帽子や眼鏡が不自然に見えることがあります。また、彼らがテーブルや食べ物、周囲のものとどのように関わっているかにも注目してください。人工的または非現実的に見えるものを探します。

ディープフェイクは驚くほど広まっており、その多くは説得力があります。ただし、多くの場合、いくつかの簡単な手順を実行するだけで、写真やビデオが本物かどうかを判断できます。普通の人の反応と違うように思われる場合は、それを警告サインとみなしてください。画像や動画のソースを必ず確認してください。

コメントは締め切りました。