世界を理解するために、Gemini Live の具現化を体験しました。衝撃です!

AI が妙にフレンドリーな口調で話し、ワークステーションの混乱を解消するように頼むのを聞くと、不安になります。かなり満足していますが、そろそろ散らばった工具を積み重ねて、絡まった配線を整理する時期が来たと思います。

私の妹も同意するでしょう。しかし、AI が私のデスクを「見て」、散らかっている状態を認識し、家事のヒントを提供し、すぐに行動に移すというのは、より大きなことです。 Google の Gemini AI チャットボットはまさにそれを実現できるようになりました。その他にも多数あります。

ここでの秘密は、Project Astra と呼ばれる最近の機能アップデートです。何年も開発が続けられ、ようやく今月初めに展開が開始されました。全体的なアイデアは、すべてを見て、すべてを聞いて、オープンにインテリジェントな AI を携帯電話に提供することです。

Google はこれらのスーパーパワーを、「カメラと画面共有を備えた Gemini Live」というあまり魅力のない名前で販売しています。同社のDeepMind部門によって開発され、同社は汎用AIアシスタントとして開発を開始した。最終的な名前が野心的ではないのは残念です。

まずはアクセスモードから始めましょう。この機能はユーザーが利用できるようになりました。 ピクセル9 و ギャラクシーS25。ただし、Gemini Advanced サブスクリプションに加入した Android スマートフォンをお持ちの場合は、新しいツールキットにアクセスできます。

ちなみに、月額 20 ドルになります。上記の 13 つの電話で試してみましたが、OnePlus XNUMX でも動作するようになりました。一番甘いところは?そこに到達するために技術的な困難を経験する必要はありません。

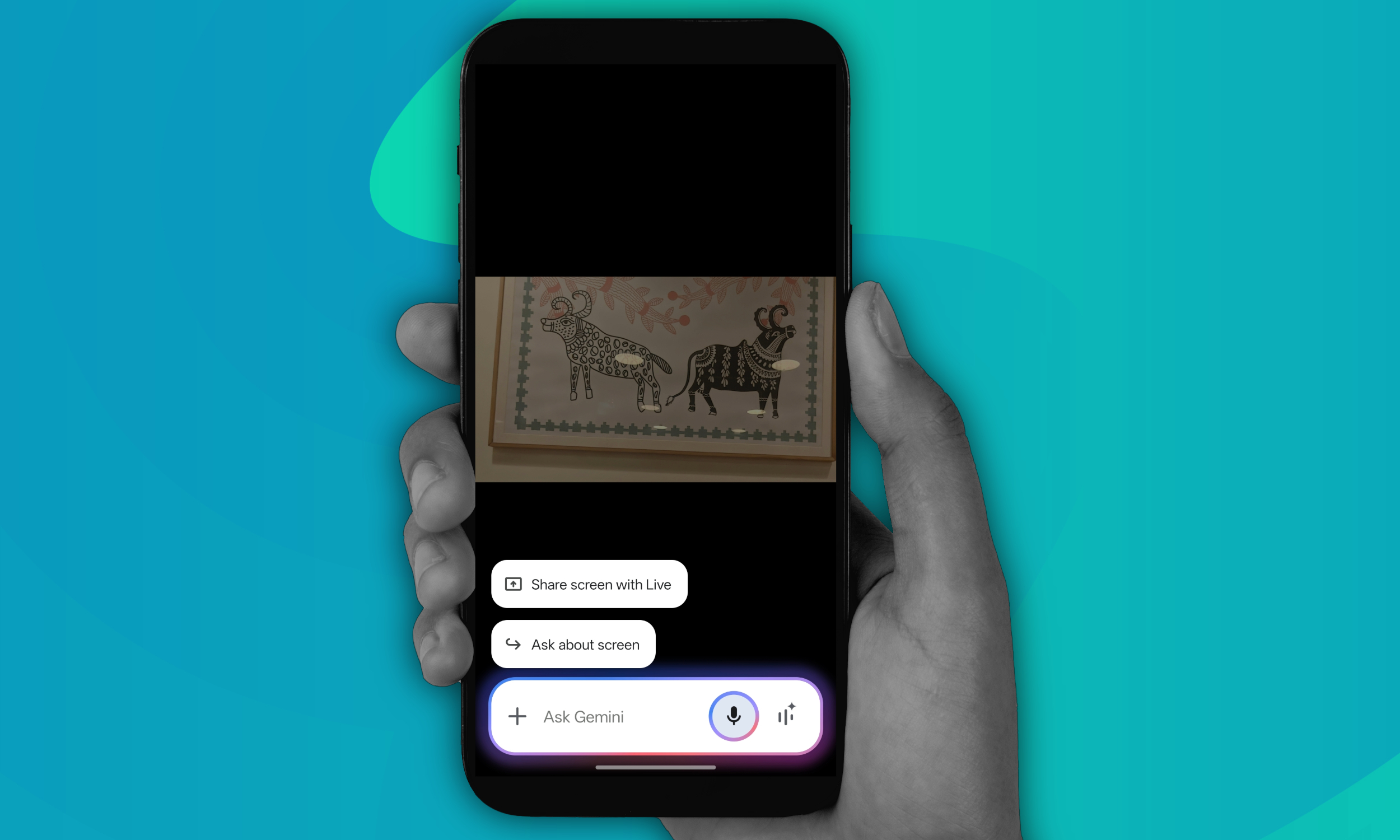

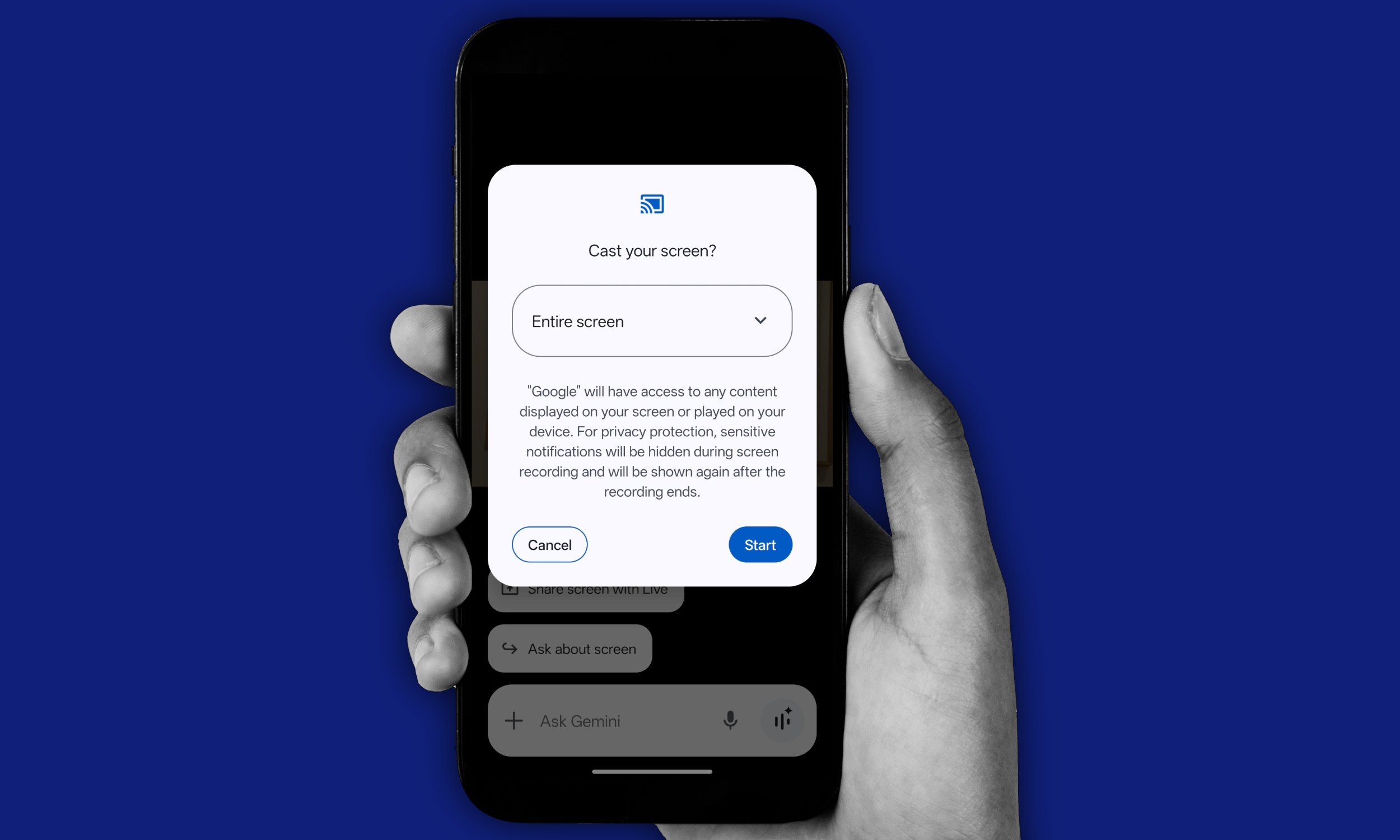

電源/音量ボタンの組み合わせ、または画面の隅をスワイプして Gemini を呼び出すだけで済みます。どのアプリを実行している場合でも、OS のあらゆる場所でオーバーレイとして新しいカメラと画面共有にアクセスできます。

周囲の世界を理解する

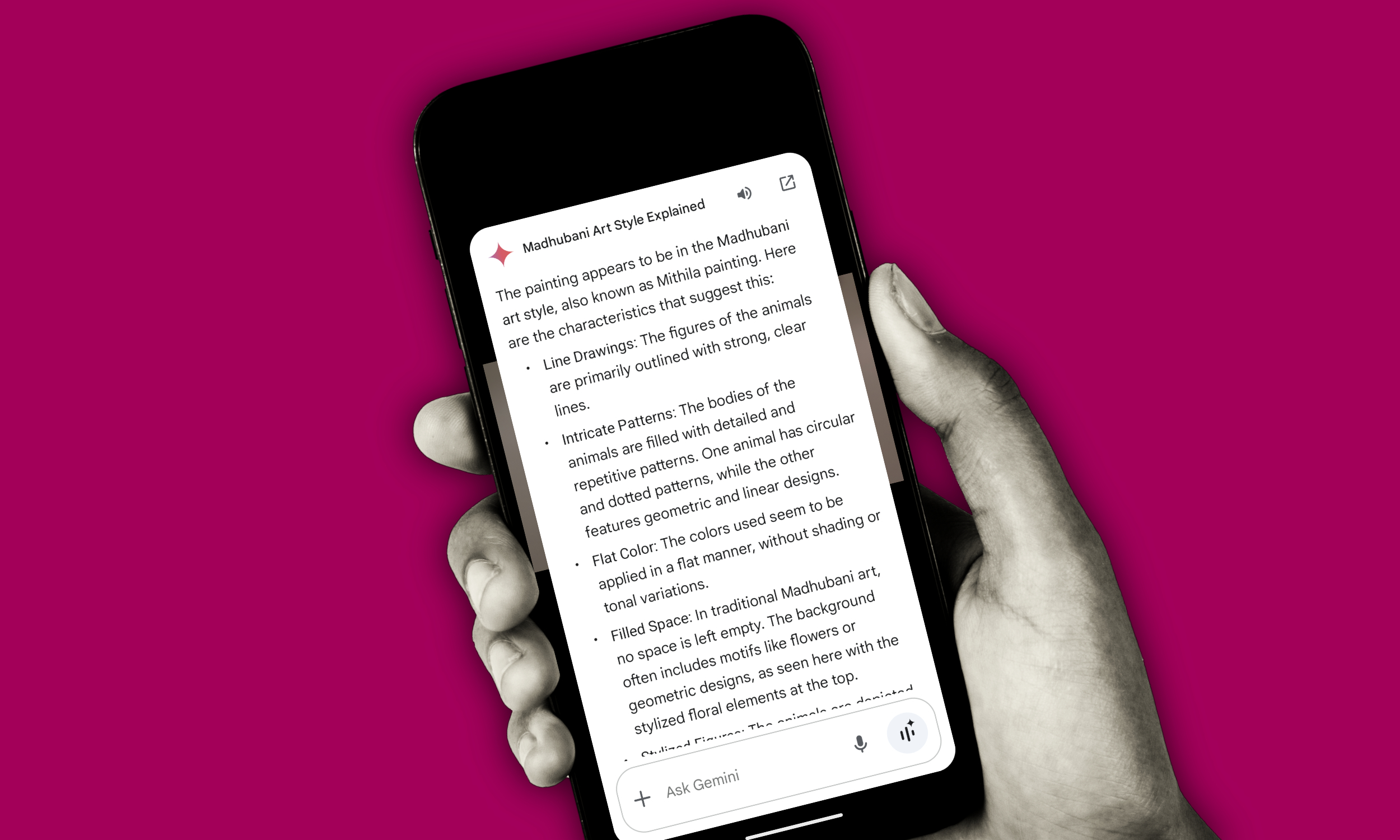

私は絵にカメラを向けて、それについて尋ね始めました。 Gemini Live は、大胆な色使いと動物の描写を解読し、これをマドゥバニ様式の絵画であると正確に検出することができました。

それから彼は私に歴史と長年にわたり生じた違いについて簡単に説明してくれました。情報は細部に至るまで正確でした。幸いなことに、音声会話が困難な場所にいる場合は、Gemini でテキスト会話を選択することもできます。

Gemini Live の新しいカメラと画面共有機能で私が最も気に入っているのは、あまりおしゃべりではないことです。いつでも割り込むことができるので、「自然な」会話の魅力が増します。

私はさまざまなシナリオで Gemini を試しました。私はそれに備えていませんでした。

彼の答えは通常は簡潔で、長すぎる答えを返すのではなく、追加の質問をする機会(または促し)を与えようとしているかのようです。さまざまな視覚テーマやシナリオで優れていますが、いくつか落とし穴もあります。

まだ Google Lens を使用できないため、Gemini は携帯電話の画面に表示される画像とウェブ上の一致する結果を比較できません。さらに、Gemini にトピックや人物に関する最新の動向を検索するよう依頼しても、リアルタイムの情報にアクセスすることはできません。

私は彼に、植物の種類、レストランのメニュー、掲示板から得たデータ、最近かかったインフルエンザに対する処方箋などについて尋ねました。 Gemini のパフォーマンスは非常に優れており、これまで私が経験したどの AI チャットボットよりも優れていました。

ナレッジバンクの活用:詳細な分析

次に、双子座はあなたに複雑な学問的主題を理解するように促します。機械学習に関する本をカメラのフレームに入れました。 Gemini Live はそれを認識しただけでなく、本の内容と主なテーマの概要も教えてくれました。この能力は、機械学習に対する高度な理解と複雑な情報を要約する能力を反映しています。

興味を持ってページをめくっていくと、章のリストを見つけました。 AIは進捗を認識し、会話をやめて、私がトピックのリストを確認しているときに、特定のクラスに興味があるかどうかを尋ねました。この機能は、ユーザーのインタラクションにリアルタイムで適応して応答する Gemini の能力を示しており、インタラクティブな学習のための強力なツールとなっています。

この瞬間、私は完全に驚きました。

私は AI にいくつかの複雑なトピックを分析するように依頼しましたが、ページ上の資料を超えて独自の膨大な知識バンクから情報を引き出すなど、立派な仕事をしてくれました。

例えば、ビシャム・サーニの小説『タマス』の紹介ページの内容について質問したところ、AIはサヒティヤ・アカデミー賞への言及を正しく拾い上げました。その後彼は、彼女が権威ある文学賞を受賞した年やその小説の内容など、そのページには記載されていなかった詳細についても言及した。これは、AI がコンテキストを理解し、追加情報を抽出する能力を示しています。

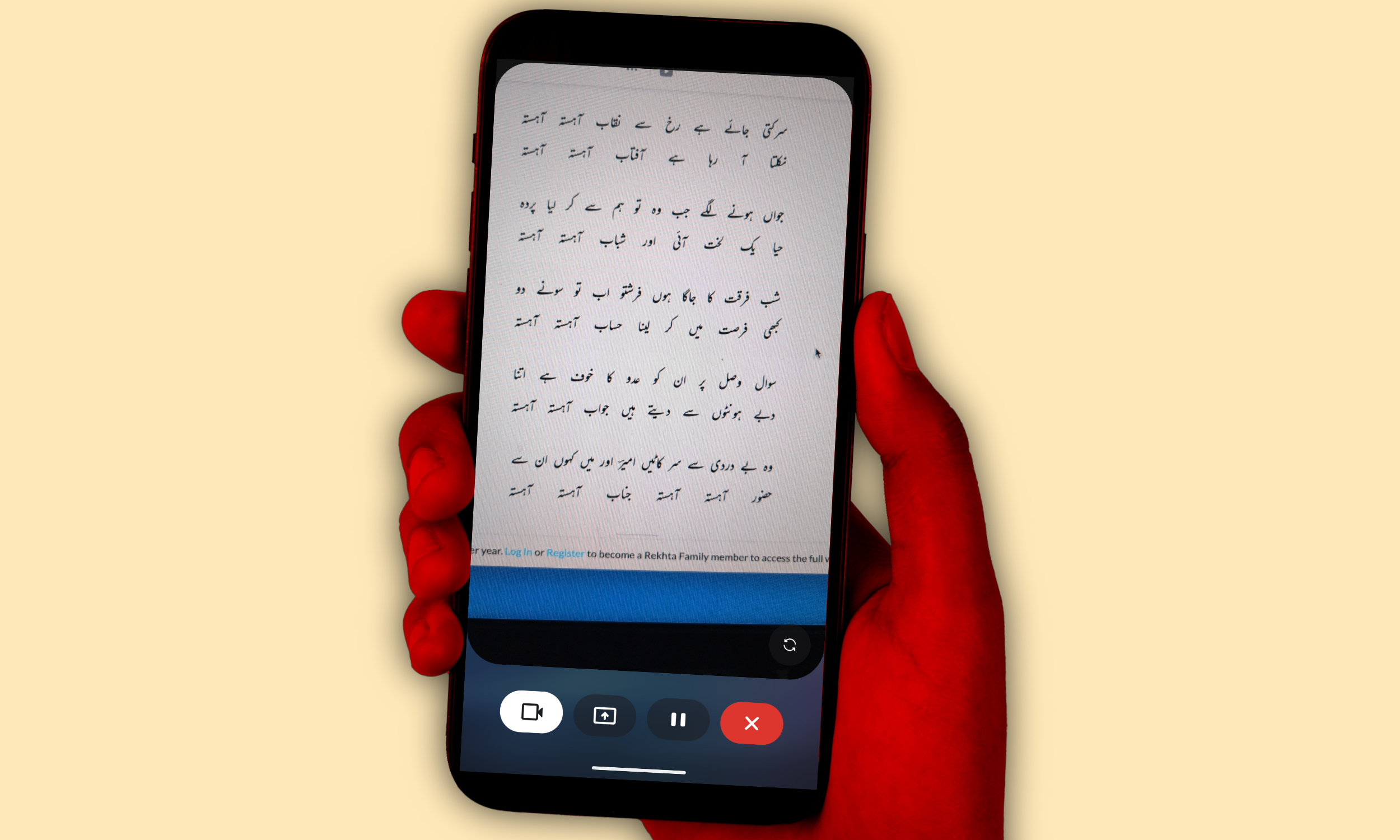

一方、Gemini Live でヒンディー語を読むのはひどいものでした。単にアクセントが悪いというだけではなく、ジェミニは意味不明な言葉を頻繁に発していました。ウルドゥー語、ペルシャ語、アラビア語を読もうとしたとき、彼はかなり上手に読むことができましたが、ランダムな行の単語を混同することがよくありました。これは、Gemini のパフォーマンスは言語によって異なり、一部の言語では大幅な改善が必要になる可能性があることを示しています。

私が初めてウルドゥー語の詩を試みたとき、彼はウルドゥー語のテキストを認識しただけでなく、詩の正確な要約もくれました。最大の課題は、やはり物語でした。英語版のウルドゥー語を聞くと本当に耳が痛くなりました。これは、特に外国語を扱う場合、ユーザー エクスペリエンスにおける発音とアクセントの品質の重要性を強調しています。

予想外の場所で優れている

人工知能は優れた問題解決ツールであり、それを証明するベンチマークも数多くあります。手書きのノートに載っている熱力学、電気化学方程式、統計学に関する物理学の問題でテストしました。 Gemini Live はこれらのタスクをうまくこなしました。

彼は創造的な仕事でも優れた才能を発揮しました。ファッションデザイナーである私の姉は、スケッチの 1 つをカメラの視野内で見せ、フィードバックと改善点を求めました。 Gemini Live は、まずデザインを賞賛し、いくつかのファッション ブランドのデザイン理念と比較し、いくつかの推奨事項を提示することから始まりました。これらの推奨事項は、デザインの改善に非常に役立ちました。

AIがPlusを導入することになった時、彼は妹に手描きのスケッチをデジタルコンセプトに変換するのに最適なツールについてもアドバイスしてくれました。さらに、ソフトウェアパッケージに関する役立つ情報や、教材の入手先についても教えてくれました。このアドバイスは、デジタルデザインプロセスを効率化する上で非常に役立ちました。

デュラセルの電池を2つカメラの視野内に置くと、カメラは電池を正確に認識しただけでなく、数分以内に配達できる地元の電子商取引プラットフォームも教えてくれました。この機能は、製品とその現地での入手可能性を識別する際に特に役立ちました。

BlinkitとSwiggy Instamartと呼ばれるこれらのサービスはインドでのみ利用可能で、主に都市部を対象としている。薄暗い部屋でも、最初の試みで有線イヤホンを識別することができました。これは、さまざまな状況で物体を認識する人工知能の能力を示しています。

状況認識力が彼の最大の強みです。

通常の Gemini チャットや Google 検索の AI 概要セクションで見つかる情報と比較すると、Gemini Live チャットでは、特に機密性の高い情報については、知識の配布に慎重なアプローチが取られます。食べ物の推奨や治療などのトピックはますます慎重なアプローチで扱われるようになり、ユーザーに適切な専門家のリソースを見つけるように指示することが多いことに気づきました。この注意事項は、特に専門知識を必要とする分野において、正確で信頼できる情報を提供することに Google が注力していることを反映しています。

よくある課題

私の主な結論は、プロジェクト・アストラのジェミニへの変革は非常に印象的であるということです。スマートフォンが実現できる未来を垣間見ることができます。いくつかの改善、統合、アプリ間のワークフローにより、Google 検索はまるで遺物のように感じられるかもしれません。しかし現時点では、いくつか明らかな欠陥があります。

何度か、私の記憶システムがおかしくなっていたことに気づいたことがあります。 AIにカメラの視野内でフィットネスバンドを識別するように依頼したところ、それをSamsung Galaxy Fit 3であると正しく識別しました。しかし、追加の質問をしたところ、デバイスはHuaweiのフィットネスバンドであると誤って識別されました。

彼は露骨に嘘をつくこともできます。そして、私は完全な自信を持ってそう言えるでしょう。たとえば、ウェアラブルのレビューを要約するように依頼したところ、AIはDigital Trendsがまだレビューしていないと返答しました。実のところ、この記事は1週間前に公開されました。

次に、画面共有を有効にして、著者ページの記事をいくつか閲覧するように依頼しました。ジェミニは物語をうまく説明しましたが、文脈の理解につまずくことがありました。たとえば、バッジの対象となるニューラル プロセッシング ユニット (NPU) を作成できるのは Intel と AMD のみであると誤って記載されていました。 副操縦士+.

一方、記事では、クアルコムが競合他社に先駆けてこの基準を最初に満たしたと明記されています。 AMD と Intel がようやく新しいプロセッサのラインアップで AI チップの基準を満たすことができたのは、昨年末になってからでした。

記事についての会話の途中で、彼は再び記憶障害に陥った。彼は議論中のストーリーを要約する代わりに、画面共有で最初に見た記事について話を再開しました。私が彼のナレーションの途中で割り込むと、ジェミニは間違いを訂正しました。

英語以外の言語のナレーションで気づいたもう 1 つの問題は、Gemini Live がナレーションの途中で音声と速度をランダムに変更することです。それは非常に迷惑で、発音は完全にロボット的で、彼の人間のような英語力とはまったく異なっていました。

滑らかなラインの場合、機械視覚の困難も生じます。いくつかの場面では、AI は自信たっぷりに間違った情報を吐き出し、訂正を求められたときに、そのトピックに関する最新情報を見つけることができないことを表明しました。こうしたシナリオはまれですが、ジェミニの間違いは残ります。

まとめると、カメラと画面共有機能を備えた Gemini Live は、AI がこれまでに成し遂げた最大の飛躍の 1 つだと思います。これは、現在までに最も実用的かつ有益な生成 AI のアプリケーションの 1 つです。彼に必要なのは、ちょっとした変化と「自信過剰嘘つき」症候群の克服だけだ。

物事は間違いなく、圧倒的に正しい方向に進んでいますが、テクノロジーの未来学者の夢を実現する完璧な AI の仲間となるには、まだいくつかの重要なマイルストーンが残っています。

コメントは締め切りました。