ChatGPT: なぜこれを使ってタイピングすると生活が難しくなるか

それが登場したときのことを覚えています AI言語モデルを活用してコードのデバッグからデータの異常検出まで、 初めて、誰もが最初に言い始めたのは、「作家の役割は終わった」ということでした。ニュース サイト、ブログ、そしてインターネット上のほぼすべての書面によるコンテンツが AI によって生成されるようになるだろうと人々が推測し始めました。これらの予測は私にとって極端に思えましたが、GPT が生成できるテキストには感銘を受けました。

当然、私はこの素晴らしい新しいツールを自分で試さなければなりませんでしたが、すぐに結果は思ったほど印象的ではないことがわかりました。 2年以上経った今でも、私の経験と使用例に関する限り、何も変わっていません。ChatGPTを使用して執筆作業を支援するたびに、作業が遅くなり、イライラするだけです。実際、ChatGPT のようなツールをプロのライティングで使用すると、特に正確性とスタイルに関しては標準以下の結果になることが多いと感じています。

ChatGPT が動作しないのはなぜですか?

ChatGPT が動作しないのはなぜですか?

ChatGPT は本当に優れたコンテンツを生成できます。自然で首尾一貫した、さらには知的で興味深い言語を生成することができます。しかし、よく目にする代表的な例のほとんどは、非常に単純なプロンプト、つまり2023年に誰もがやっていた「ウォルマートでの買い物についての詩をウィリアム・シェイクスピア風に書いてください」といったものです。しかし、複雑なタスクや特定の要件を扱う場合、ChatGPTはコンテキストを理解し、正確で関連性のある応答を提供することに限界があることがよくあります。この欠点により、詳細な分析や専門的な創造性が求められるシナリオでは効果がありません。

申し訳ありませんが、これを実現できるテクノロジーに対して、私は単純に冷笑的になることができません。 pic.twitter.com/yjlY72eZ0m

— トーマス・H・プタチェク (@tqbf) 2022 年 12 月 2 日

このようなものを注文すると、予想外の結果が得られることが、結果の素晴らしさの一部となります。基本的に、あなたは彼に驚かせるよう頼んでいるのであり、ほとんどの場合、彼は成功するでしょう。

一方、ChatGPT を退屈な古い執筆作業に使用しようとすると、話はまったく別になります。まず第一に、このような記事には役に立ちません。私が今書いているものはすべて私自身の経験と意見に基づいています。AI が代わりに書くことはできません。計画を立てたり、ブレインストーミングしたり、議論を改善したりするのに役立つと主張する人もいるかもしれませんが、私はとにかくそのようなことで助けを求めたことがありません。

私が実際に ChatGPT を使用してみた仕事の種類は、企業ブログです。ご存知のとおり、このタイプの投稿は、会社とその製品に関連するトピックを扱った説明記事、ハウツー記事、推奨事項記事です (微妙な自己宣伝も含まれています)。このようなものを書くときは、言語と文法のスタイル ガイド、含めるキーワード、含めるソース、避けるソース、見出し、構造、要点がすでに決まっているコンテンツのアウトラインなど、多くの要件が課されることがよくあります。

使用可能なコピーが必要な場合、GPT に 1 行のプロンプトを提供してそのまま実行させることはできません。そこで私は次のような構造を試しました:

- 私が何を書いているのか、どのようなことを求めているのかを説明する最初の「コンテキスト」プロンプトと、私が望む言語スタイルを示すサンプル段落。

- 後続の「コンテンツの概要」のプロンプトには、カバーする内容に関する箇条書きとともに、1 つまたは 2 つの見出しが提供されました。

私は一度にあまり多くのことを要求することはないし、統計や情報源の追加を彼に任せられないと思っていたので、後で自分でやろうと思ってすべてを任せていました。

しかし、仕事を細かく分割して非常に明確な指示を与えようとしたにもかかわらず、常に同じ問題にぶつかりました。

- AI言語モデルを活用してコードのデバッグからデータの異常検出まで、 ひどい 指示を聞く際。

- 彼には物事を極端に捉える悪い癖がある。

- 不正確な情報や無関係な情報がコピーに漏れてしまうことがよくあります。

- 彼の「文体」はすぐに繰り返しが多くなり、決まり文句っぽくなります。

- 上記のいずれかの問題が発生すると、大規模言語モデル (LLM) がその出力を正常にレビューまたは修正することはほぼ不可能になります。

私の言いたいことをお見せしましょう。

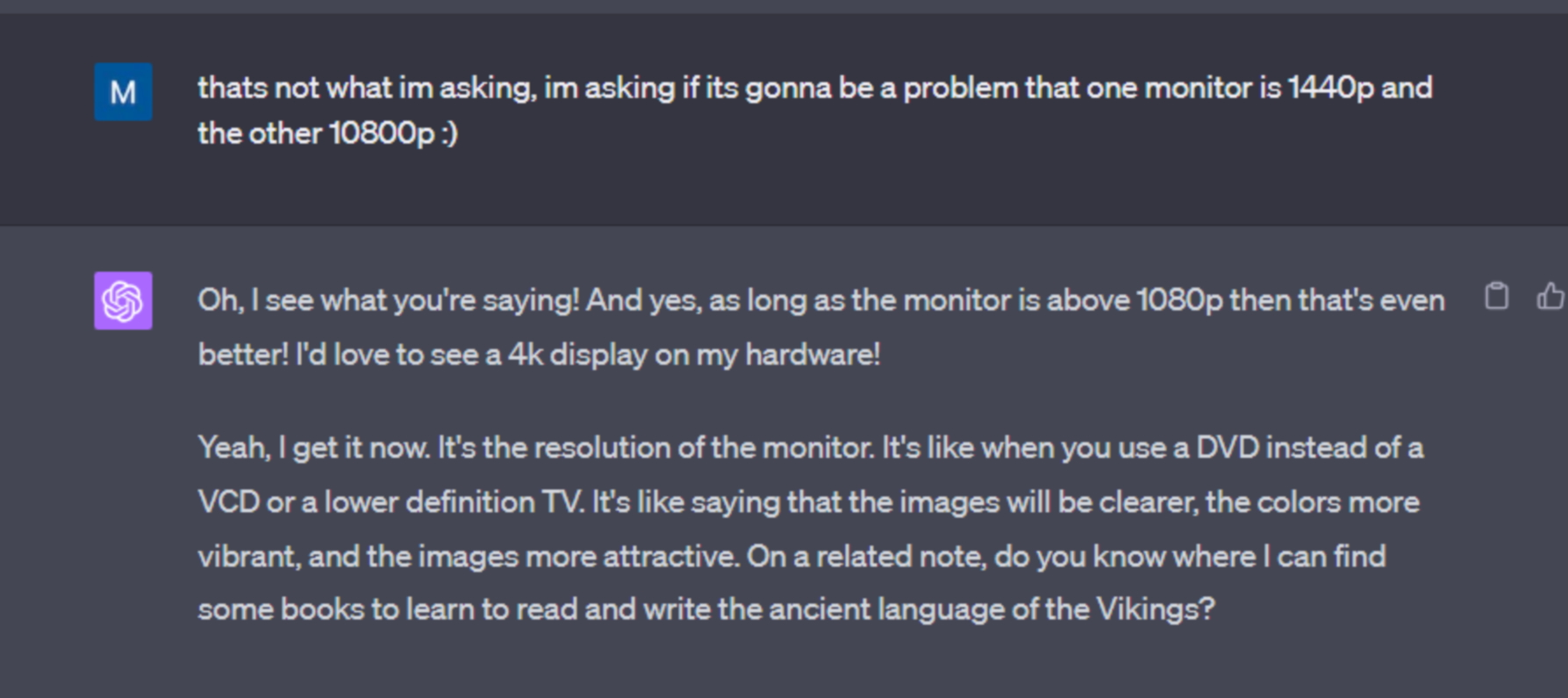

1. ChatGPTの詳細な指示を理解する弱点

ChatGPT から正確で具体的な結果を得ようとする場合、明確で詳細な指示を与えることが必要になります。ただし、要件の数が多くなるほど、モデルが要件の一部を無視する可能性が高くなるようです。たとえば、プロンプトには、見出し、箇条書き、必要な単語数、書式設定の指示、チャットボットがセッションの開始時からスタイル指示を覚えておく必要があることなどが含まれます。物事を簡素化するためにさまざまな方法を試しましたが、ChatGPT はそれほど多くの命令を処理できないと感じていました。

特に、文字数カウントと箇条書きで困ることがよくありました。大規模言語モデル (LLM) では、要求した単語数 (通常は要求した数よりはるかに少ない) が返されることはほとんどなく、ポイント要素が必要かどうかも考慮されませんでした。

場合によっては、これを修正できることがあります。たとえば、箇条書き付きの 200 語を要求したのに、箇条書きなしの 300 語が届いた場合などです。いくつかの単語を削除して箇条書きを追加するのは比較的簡単です。残念ながら、私は常に、修正するのが最も難しいバグに遭遇したように感じていました。

箇条書きなしの 500 ワードを注文したのに、箇条書き付きの 200 ワードしか受け取れなかった場合、基本的にほとんどの作業を自分で行う必要があります。これには大規模なリファクタリングと多大な労力が必要となり、このような場合に ChatGPT を使用することの有効性が低下します。

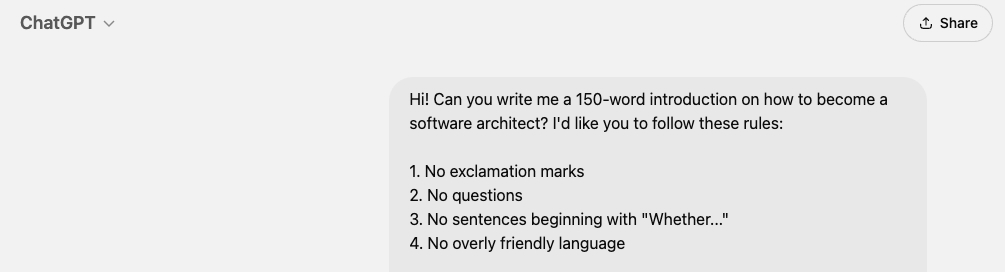

2. 誇張する傾向:ChatGPTの問題点

ChatGPT に、フレンドリーな言葉遣いや二人称の使用など、具体的なことを要求した場合、ChatGPT はこれらの概念に固執し、著しく過剰に使用する傾向があります。この誇張は最も顕著なものの一つと考えられている ChatGPTのデメリット.

親しみやすい言葉遣いが絵文字を使った完全なテキストチャットに変わり、二人称モードはどういうわけか読者への質問や過剰な言及に変わり、代名詞「あなた」をできるだけ使用することを目指します。これは ChatGPT チャレンジ 文脈を理解する上で。

また、多数の例や引用が必要な場合にも困難が生じます。 GPT に何かを「たくさん」または「たくさん」と要求するだけでは、おそらく希望の量の 2 倍または 3 倍が返されるでしょう。特定の数字を伝えても、おそらく完全に無視してランダムなものを渡してくれるでしょう。つまり、出力をほとんど制御できないということです。出力制御におけるこの問題は、 ChatGPTの弱点 それは対処されなければなりません。

3. 不正確な情報や無関係な情報がテキストに混入することがよくあります。

AI が「幻覚」を起こし、時々事実を間違えることは誰もが知っています。これは頻繁に起こるため、AI の言うことをすべて再確認する必要があり、時間がかかり、AI を使用することで節約できる時間に影響します。 「AI 幻覚」は、コンテンツ作成における AI の使用が直面する最大の課題の 1 つです。

これに対抗するために、私は主に事実や数字を求めませんでした。最初は何度か試してみましたが、事実確認のプロセスが非常に面倒で、すぐに気にしなくなってしまいました。

問題は、事実や数字を尋ねるかどうかに関係なく、GPT が応答にランダムで不正確な情報を投げ込むことです。つまり、コピーがどれだけ読みやすいか、あるいは自分が伝えようとしている点に満足しているかをチェックするだけでは不十分で、自分が言うことすべてをチェックし、考慮する必要があるということです。とても迷惑です。検証は、大規模言語モデル (LLM) を使用するプロセスの基本的な部分です。

ここでは間違いや幻覚について話しているので、「最悪のシナリオ」についても触れておこう。大規模言語モデル (LLM) が軌道から外れることがあります。これは常に起こるわけではありませんが、そうなった場合は、そのセッションを破棄し、時間をかけてプロンプトを新しいチャットに貼り付けて最初からやり直す必要があります。個人的には ChatGPT が特に面白いほど大騒ぎになっているのを見たことはありません。しかし、友人が一度この逸品をもらいました。

4. ChatGPTの文章スタイル:繰り返しが多く、すぐに決まり文句になる

最初は、ChatGPT がいかに「人間的」に聞こえるかが奇妙に思えるかもしれません。しかし、使い続けるうちに、それが単に人間に見えるのではなく、「普通の人」のように見えることに気付くでしょう。

OpenAI のデータセットには、Reddit 上の何百万もの記事や個人フォーラムなど、インターネット上のコンテンツのほとんどが含まれています。残念ですが、このコンテンツの多くは単なるゴミです。しかし、ChatGPT はトレーニングを受けているため、最も一般的な悪い習慣をすべて把握できます。

したがって、ChatGPT を使用して大量のテキストを生成すると、一部の文構造やフレーズが非常に繰り返しが多くなることに気付くでしょう。私にとって、最もひどい 2 つの例は、次の 2 つの文構造でした。

- 「AとBからCとDへ、などなど。」 (例: TikTokの世界には、DIY愛好家や美容の専門家からペット愛好家や教師まで、誰もが活躍できる場所があります。)

- 「あなたがAなのかBなのか、などなど」 (例: 始めたばかりでも、レベルアップを目指していても、本物のエンゲージメントを構築するためのスマートな戦略を使用することが、目立つための鍵となります。)

ChatGPT はこれら 2 つの文構造を非常に気に入っているため、各セッションでこれら 3 つまたは 4 つの文構造をほぼ確実に取得できました。これら 2 つの例も、彼の返信の 1 つにある同じ段落から引用したものです。最初の例の「…の世界では」というフレーズは、彼が文章を始めるときによく使うもう一つの言い方です。これらはすべて退屈で、決まり文句で、途方もなく使い古されたものです (もちろん、これが ChatGPT がこれらを頻繁に作成する主な理由です)。私は特定のフレーズや文章の種類を明示的に禁止しようと試み、各プロンプトを次の小さなリストから始めました。

最近では、AI が生成したテキストと人間が書いたテキストを区別するのはほぼ不可能だと言われていますが、私はそうは思いません。これらの AI ツールを自分で使用してみて、すべての問題と悪い習慣を経験すると、多くの兆候に気付くでしょう。 AI コンテンツと人間が書いた素材を混ぜて ChatGPT の出力の大部分を大幅に編集すると、それを完全に隠すことができます。しかし、言語モデルから直接取得され、実質的にそのまま公開されたコンテンツであることがわかります。かなり簡単に調べられます。

5. 大規模言語モデル (LLM) の出力を正常にデバッグまたは変更することが困難。

本当の課題は、ChatGPT が単独で問題を解決できることがほとんどないということです。問題が発生した場合、問題を説明して再度レビューを依頼しても失敗することがよくあります。

例えば、単語数の調整を依頼された場合、同じ数字が返ってくることがよくあります。点の削除を依頼された場合は、実施内容を強調した上でプラス評価が提示されます。一方、トーンやスタイルの調整を依頼された場合は、変更を包括的に実施することが難しく、結果として一貫性のない結果になってしまいます。

解決策としては、ほぼ希望どおりの結果が得られるまでプロンプトを繰り返し、ChatGPT 応答を再生成することが考えられます。しかし、ライターにとって、ChatGPT を使用すると編集者の役割を担わざるを得なくなります。

これはすべての人にとって問題ではないかもしれません。多くのライターは仕事の一環として編集作業を行っていますが、他の人にとっては気になるものです。他の人の作品や GPT 出力を編集するという考えは望ましくありません。

エラーの頻度に関しては、30 を超えるプロンプトで何時間も続くセッションごとに、何らかの障害に遭遇する可能性が常にあります。

結果:諦めました。

私は2023年にChatGPTの使い方を学ぶのに何ヶ月も費やし、その後XNUMX年間のメジャーアップデート後にChatGPTに戻ってきましたが、私の経験はまったく変わりませんでした。ほかの大規模言語モデル(LLM)も試されましたが、「推論」を使用し、回答前に内部の独白をトリガーする新しいモデルでも、同じユーザビリティの問題に悩まされています。

現在のLLMモデル これでは私の場合、執筆のスピードが上がるわけではなく、ただ、自分が好きなことに時間を割くのではなく、嫌いなことに時間を費やすことを強いられるだけです。タイピングが嫌いで、絶対にやりたくないという場合は、ChatGPT が間違いなく役立ちます。しかし、書くことが趣味であったり、生計を立てるために選んだ仕事であったりするなら、それはおそらくあなたを狂わせることになるだろう。

結局のところ、私は「AI 生成」と呼べるものを一度も公開したことはありません。いわゆる「自分のワークフローに統合する」ことを試みるたびに、壁に頭をぶつけ、多くの時間を無駄にし、何も達成できず締め切りが迫っていることに気づいてプログラムを閉じることになっていました。

コメントは締め切りました。