エンタープライズAIのリスク:OpenAIの代替案とAIエージェントを支える組織

現在の AI エージェント統合におけるデータ プライバシー、コンプライアンス、信頼のギャップ

「ちょっと待ってください…元帳のエントリを OpenAI に送信しているのですか?」

これを友達に見せた時に最初に聞かれたのはこれでした。 感じて書くサンフランシスコのハッカソン中に私が作成した AI 搭載ジャーナリング アプリです。

私は肩をすくめた。

「AIをテーマにしたハッカソンだったので、すぐに何かを作る必要がありました。」

彼女は一瞬たりとも見逃さなかった。

「もちろんです。でも、自分が作ったものをどうやって信頼できるというのでしょう? 自分でLLMをホストしてみてはどうでしょうか?」

それで私は立ち止まりました。

アプリがいかに早く完成したかを誇りに思いました。しかし、この 1 つの質問とそれに続く質問によって、AI を責任を持って構築することについて私が知っていると思っていたことがすべて明らかになりました。ハッカソンの審査員もその点に触れていました。

その瞬間、私は AI を使って構築するとき、特に機密データを扱うツールを使うとき、私たちがいかに無礼であるかを実感しました。

私はもっと大きなことに気づきました。

AI を使って構築する場合、信頼については十分に話し合われません。

彼女の答えが私の心に残った。ジョージア・フォン・ミンデンは ACLU のデータ サイエンティストであり、法律および公民権の分野における個人を特定できる情報に関連する問題に密接に取り組んでいます。私はいつも彼女の洞察力に感謝してきましたが、この会話は違いました。

そこで私は彼女に説明するよう頼みました。 この文脈において信頼とは実際には何を意味するのでしょうか? 特に AI システムが個人データを扱う場合にはそうです。

彼女は私にこう言いました。

信頼関係を築くのは難しい場合もありますが、データガバナンスは良い出発点となります。データの所有者、保管方法、そして使用目的はすべて重要です。10年前なら、私はこの質問に違った答えを出していたでしょう。しかし今日では、膨大な計算能力と膨大なデータストアが存在するため、広範な推論は現実的な懸念事項です。OpenAIはコンピューティングとデータの両方に広範なアクセス権限を持っているため、透明性の欠如は慎重な対応を強いる要因となっています。

個人を特定できる情報(PII)に関しては、規制と常識の両方から、強力なデータガバナンスの必要性が指摘されています。API呼び出しで個人を特定できる情報を送信することは、単にリスクが高いだけでなく、これらの規則に違反し、個人を危険にさらす可能性があります。

AI を使って構築する場合、特に機密性の高い人間のデータを扱うシステムを構築する場合は、単にコードを書いているのではないということを思い出しました。

私たちはプライバシー、権限、信頼に関する決定を下します。

ユーザーデータ、特に日記のエントリのような個人的なデータを収集した瞬間から、責任の領域に足を踏み入れることになります。モデルが何ができるかだけが重要なのではありません。それは、そのデータがどうなるか、どこに保存されるか、誰がアクセスできるかに関するものです。ユーザーデータを責任を持って管理することで、ユーザーの信頼が高まり、プライバシーが強化されます。

シンプルさの幻想

今日では、見た目がスマートなものを立ち上げることがかつてないほど簡単になりました。 OpenAI などの大規模言語モデル (LLM) を使用すると、開発者は数時間で AI ツールを構築できます。スタートアップ企業は「AI 搭載」機能を一夜にして立ち上げることができます。機関についてはどうですか?同社はこれらのエージェントを自社のワークフローに統合することを急いでいます。

しかし、この興奮の中で、よく見落とされてしまうことが 1 つあります。 信頼.

人々がそれについて話すとき AIエージェントこれらは、大規模言語モデル (LLM) をラップする単純なラッパーを指すことがよくあります。これらのエージェントは質問に答えたり、タスクを自動化したり、さらには決定を下したりします。しかし、その多くはセキュリティ、コンプライアンス、説明責任にほとんど配慮せずに急いで構築されています。

製品を使用するだけで OpenAI 安全だという意味ではありません。本当に信頼できるのはパイプライン全体です。

- カバーを作ったのは誰ですか?

- データはどのように扱われますか?

- あなたの情報は保存、記録されていますか? あるいは、さらに悪いことに、漏洩されていますか?

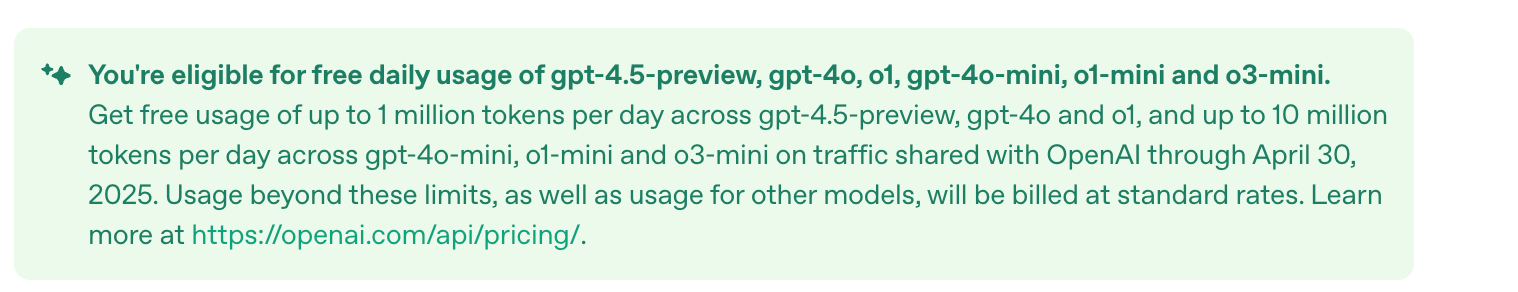

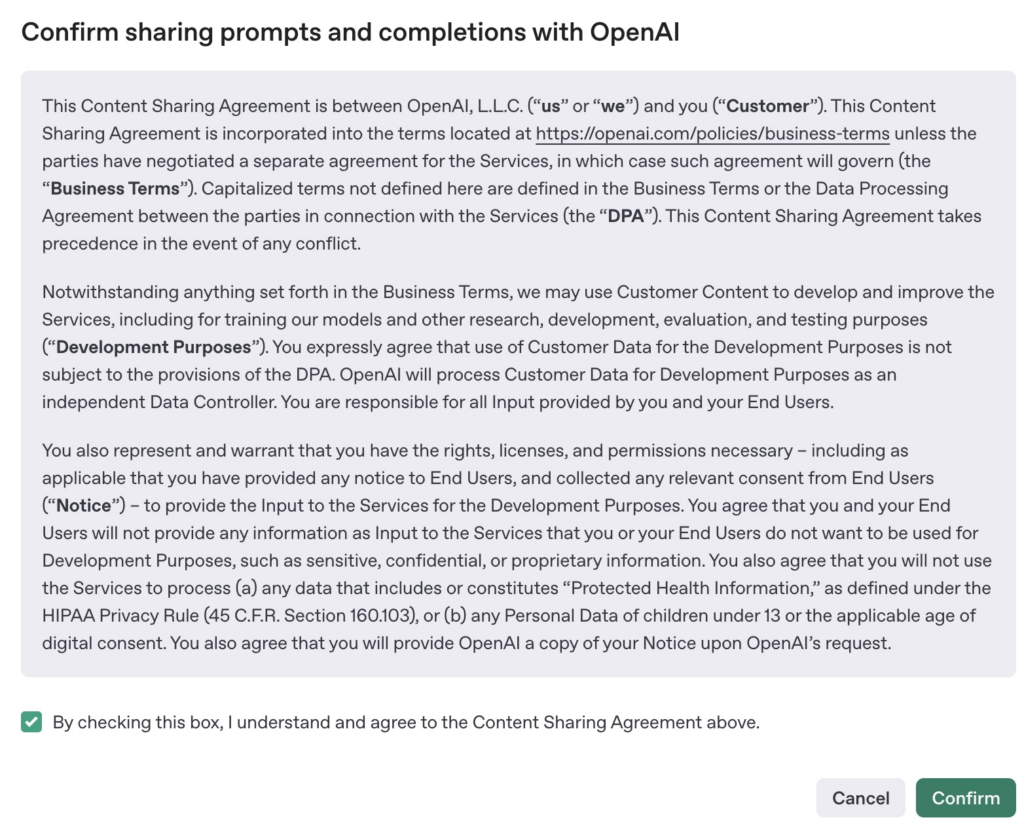

私自身、顧客のユースケースに OpenAI の API を使用してきました。最近、1月末までXNUMX日あたり最大XNUMX万トークンまでのAPIへの無料アクセスが提供されました。 請求データを共有することに同意した場合.

私は個人的なサイドプロジェクトとしてこれに同意するところだったが、その時、ソリューションプロバイダーがコスト削減のために同じ契約を結んだ場合、そのユーザーは自分のデータが共有されていることに全く気づかないだろうと気づいた。個人的なレベルでは、これは無害に思えるかもしれません。しかし、その制度の文脈ではどうでしょうか?これはプライバシーの重大な侵害であり、契約上または規制上の義務に違反する可能性もあります。

たった 1 人のエンジニアがこのような取引に「はい」と答えるだけで、顧客データは他人の手に渡ってしまいます。

エンタープライズAIが期待を高める

SaaS企業や開発ツールのスタートアップ企業で、AIエージェントの実験が増えているのを目にします。中には良い成果を上げているものもあり、中にはユーザーが独自の大規模言語モデル(LLM)を持ち込むことができるAIエージェントもあり、モデルの実行場所やデータの処理方法をユーザーが制御できます。特に企業におけるAIの重要性が高まっている今、これは賢明なアプローチと言えるでしょう。

これは思慮深いアプローチです: 信頼の制限を設定します。.

しかし、誰もがそう熱心というわけではありません。

多くの企業は、OpenAI の API に接続し、いくつかのボタンを追加するだけで、それを「エンタープライズ対応」と呼んでいます。

警告: これは真実ではありません。

何が問題になるのでしょうか?たくさん。

厳しい質問をせずに AI エージェントをインフラストラクチャに統合すると、次のような潜在的なリスクが生じます。

- データ漏洩請求には機密性の高い顧客データ、API キー、内部ロジックなどが含まれる場合があり、サードパーティのフォームに送信された場合、それらが公開される可能性があります。

2023年、サムスンのエンジニアが誤って社内のソースコードとメモをChatGPT(フォーブス)。このデータは将来のトレーニング セットの一部となる可能性があり、重大な知的財産リスクとなります。

- コンプライアンス違反適切な制御なしに OpenAI などのフォームを通じて個人を特定できる情報 (PII) を送信すると、一般データ保護規則 (GDPR)、HIPAA、または契約に違反する可能性があります。

イーロン・マスク氏のX社は、このことを苦い経験を通して学んだ。彼らは、EUユーザーを含むすべてのユーザー投稿を適切なサブスクリプションなしで使用してトレーニングしたAIチャットボット「Grok」をリリースしました。主催者はすぐに介入した。圧力を受けて、彼らは欧州連合でのグロクの訓練を中止した(政治家).

- 曖昧な行動非決定論的なエージェントは修正したり説明したりすることが困難です。チャットボットがなぜ間違った提案をしたのか、あるいは機密情報を漏らしたのかを顧客が尋ねたらどうなるでしょうか?この質問に答えるには透明性が必要ですが、今日の多くのエージェントはそれを提供していません。

- データの所有権に関する混乱製品の所有者は誰ですか?誰がデータを記録しますか?サービスプロバイダーは入力内容に基づいて再トレーニングを行いますか?

Zoomは2023年にまさにその行為をしていたことが発覚した。彼らはひっそりと利用規約を変更し、顧客の会議データをAIのトレーニングに利用できるようにしたのだ(ファースト·カンパニー)。世論の反発を受けて、政府は方針を転換したが、これは信頼が一夜にして失われる可能性があることを思い起こさせるものとなった。

- パッケージのセキュリティ上の欠陥2024年には、人気のローコードLLMオーケストレーションツールであるFlowiseのデプロイメントが数十件、インターネットに公開されていることが判明し、その多くは認証なしでした(サイバーセキュリティニュース)。研究者は、API キー、データベース認証情報、およびユーザー データが公開されていることを発見しました。これは OpenAI の問題ではありません。これは問題です。 ビルダー。しかし、エンドユーザーは依然として代償を払うことになる。

- 行き過ぎたAI機能マイクロソフトの「リコール」機能(コパイロットのロールアウトの一部)は、AIアシスタントが質問に答えるのを助けるために、ユーザーのアクティビティのスクリーンショットを自動的にキャプチャします(DoublePulsar)。それは便利そうに思えた…しかし、セキュリティ専門家がプライバシーの悪夢だと指摘するまでは。マイクロソフトはすぐに方針を転換し、この機能をオプションのみにしなければなりませんでした。

すべてに OpenAI が必要なわけではありません。

OpenAI は非常に強力なプラットフォームです。しかし、それが常に最善の解決策であるとは限りません。

場合によっては、より小さなローカル モデルで十分なこともあります。場合によっては、ルールベースのロジックの方が効果的です。最も安全なオプションは、多くの場合、独自のルールに従って、完全に独自のインフラストラクチャ内で動作するオプションです。

大規模言語モデル (LLM) を盲目的に導入して、「インテリジェント アシスタント」と呼ぶべきではありません。

施設では、 信頼、透明性、制御はオプションではありません。 ――むしろ、それは不可欠です。

この種の制御を可能にするプラットフォームはますます増えています。 SalesforceのEinstein 1 Studioがこの機能をサポートするようになりました 持ち込みモデルAWS または Azure から大規模言語モデル (LLM) に接続できるようになります。 IBM Watson を使用すると、組織は完全な監査証跡を備えたモデルを社内に導入できます。 MosaicML を使用すると、Databricks は独自のクラウド内でプライベート大規模言語モデル (LLM) をトレーニングできるため、機密データがインフラストラクチャから外に出ることはありません。

これが真のエンタープライズ AI のあるべき姿です。

結論

AI エージェントは非常に強力で、これまで実現できなかったワークフローと自動化を可能にします。しかし、特に大規模な機密データを扱う場合には、開発の容易さが必ずしもセキュリティを意味するわけではありません。

この新しいエージェントを使い始める前に、次のことを自問してみてください。

- モデルを管理するのは誰ですか?

- データはどこに保存されますか?

- 当社は規制に準拠していますか?

- 彼が何をしているのか確認してもらえますか?

人工知能の時代において、最大の脅威は悪い技術ではなく、 盲目的な信頼。

著者について

私はエレンです。6年間の経験を持つ機械学習エンジニアで、現在はサンフランシスコのフィンテックのスタートアップ企業で働いています。私の経歴は、石油・ガスコンサルティングにおけるデータサイエンスの役割に加え、アジア太平洋、中東、ヨーロッパ全体での AI およびデータ トレーニング プログラムの主導にまで及びます。

私は現在、データサイエンスの修士号を取得中で(2025年XNUMX月に卒業予定)、機械学習エンジニアとしての次の機会を積極的に探しています。紹介やつながりを歓迎していただける場合は、本当に感謝いたします。

私は AI を通じて世界に真の影響を与えることに情熱を注いでおり、プロジェクトベースのコラボレーションにも常にオープンです。

コメントは締め切りました。