Windows 11 コンピューターで大規模言語モデル (LLM) を実行するために Ollama をインストールして使用する方法

Windows マシン上で大規模言語モデル (LLM) をローカルに実行する方法は複数ありますが、Ollama は最もシンプルで効率的な方法の 1 つです。

現在、私たちのほとんどがAIと最も頻繁にやり取りしているのは、次のようなクラウドベースのツールです。 AI言語モデルを活用してコードのデバッグからデータの異常検出まで、 أو 副操縦士これらのツールを使用するにはインターネット接続が必要ですが、その代わりにほぼすべてのデバイスで使用できます。

しかし、AIアプリケーションの開発にクラウドを頼りたいと考えている人は必ずしも多くありません。特に開発者はそうでしょう。そのため、大規模言語モデル(LLM)を自分のマシン上でローカルに実行したいと考えるでしょう。そこでOllamaの出番です。

Ollamaは、幅広い大規模言語モデル(LLM)をコンピュータ上でネイティブに実行できる推論ツールです。これが唯一の方法というわけではありませんが、最もシンプルで分かりやすい方法の一つです。Ollamaを使えば、常時インターネット接続を必要とせずにAIのパワーを活用でき、データとプライバシーを完全に管理できます。

Ollamaとそれが使用する大規模言語モデル(LLM)を使って、使い始めると様々なことができますが、まずはセットアップが最初のステップです。この強力なツールを最大限に活用できるよう、このプロセスをステップごとに解説していきます。

Ollama システム要件

Ollama自体はシステムリソースをあまり消費せず、幅広いデバイスで実行できます。Windows 11、macOS、Linuxと互換性があり、WSL経由でWindows 11内のLinuxディストリビューションからも使用できます。

しかし、大規模言語モデル(LLM)自体を実行するには、より強力なハードウェアが必要です。モデルが大規模になればなるほど、必要な処理能力も大きくなります。これらのモデルを実行するには、グラフィックス・プロセッシング・ユニット(GPU)が必要です。現在、これらのモデルは、新しいCopilot+ PCのニューラル・プロセッシング・ユニット(NPU)向けに最適化されていません。

幸いなことに、比較的小規模なハードウェアでも使用できる小型モデルがあります。例えば、GoogleのGemma 3モデルは1億パラメータのモデルですが、フルモデルの実行に必要なビジュアルランダムアクセスメモリ(VRAM)はわずか2.3GBです。9億パラメータのモデルになると、必要なVRAMは4GB以上に増加します。

MetaのLlama 3.2も同様で、1億パラメータのモデルを正常に動作させるには、わずか4GBのVRAMを搭載したGPUしか必要としません。8億パラメータのモデルでは、VRAMは3GBに増加します。

つまり、少なくとも 8GB の RAM と専用の GPU を搭載した比較的新しいコンピューターをお持ちであれば、Ollama を使用することで何らかのメリットが得られるはずです。

Windows 11 での Ollama インストール ガイド

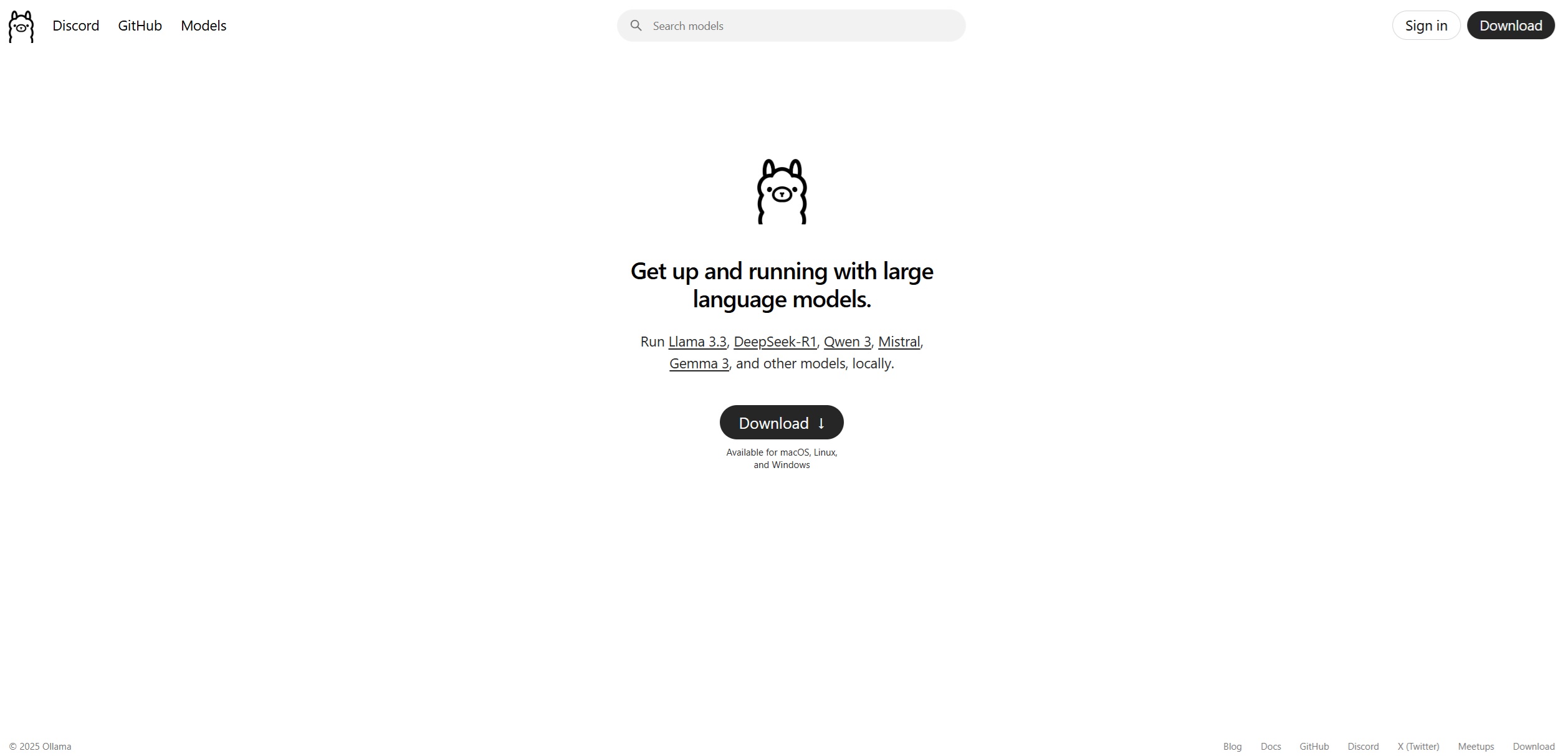

Windows 11にOllamaをインストールするのは非常に簡単なプロセスで、ダウンロードにまとめられています。 公式サイトからプログラムをインストールする またはから GitHub リポジトリをダウンロードし、デバイスにインストールします。

これらは簡単な手順です。

インストールと起動後、デスクトップには何も表示されません。プログラムは完全にバックグラウンドで実行されますが、タスクバーにアイコンが表示されます。

プログラムが正常に動作しているかどうかを確認するには、次のアドレスにアクセスしてください。 localhost:11434 Webブラウザで。

Ollamaに最初の大規模言語モデル(LLM)をインストールして実行する

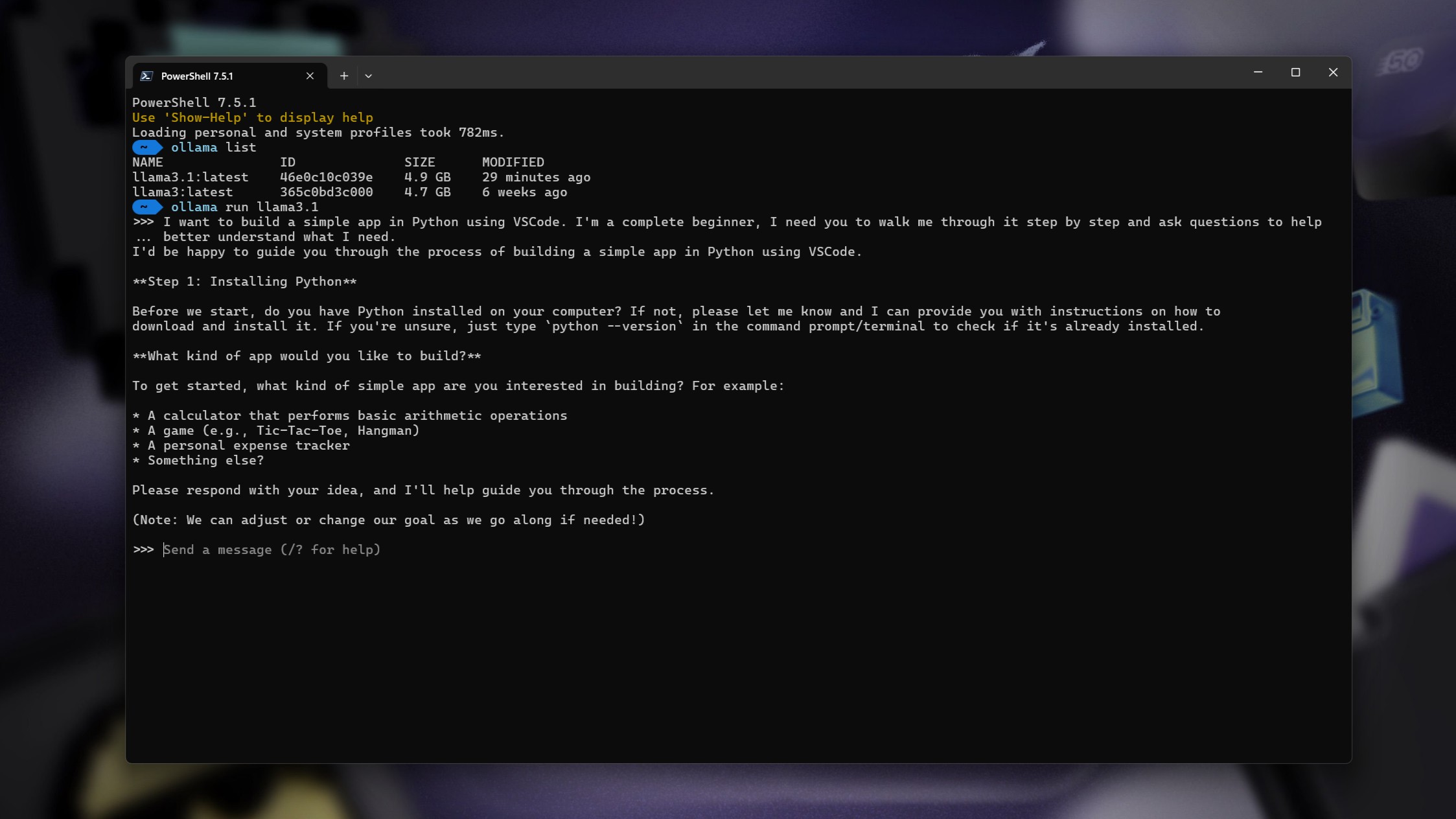

Ollamaを使って初めて大規模言語モデル(LLM)を実行するには、まずコマンドラインインターフェース(CLI)を使用する必要があります。WindowsではPowerShellを開くか、Ollamaがインストールされている場合はWSLを使用してください。

Ollamaにはグラフィカルユーザーインターフェース(GUI)もありますが、ここではコマンドラインの使用に焦点を当てます。CLIの使用に慣れている場合は、そちらが役立ちます。

知っておくべき主な 2 つの点は次のとおりです。

走る

それを置く

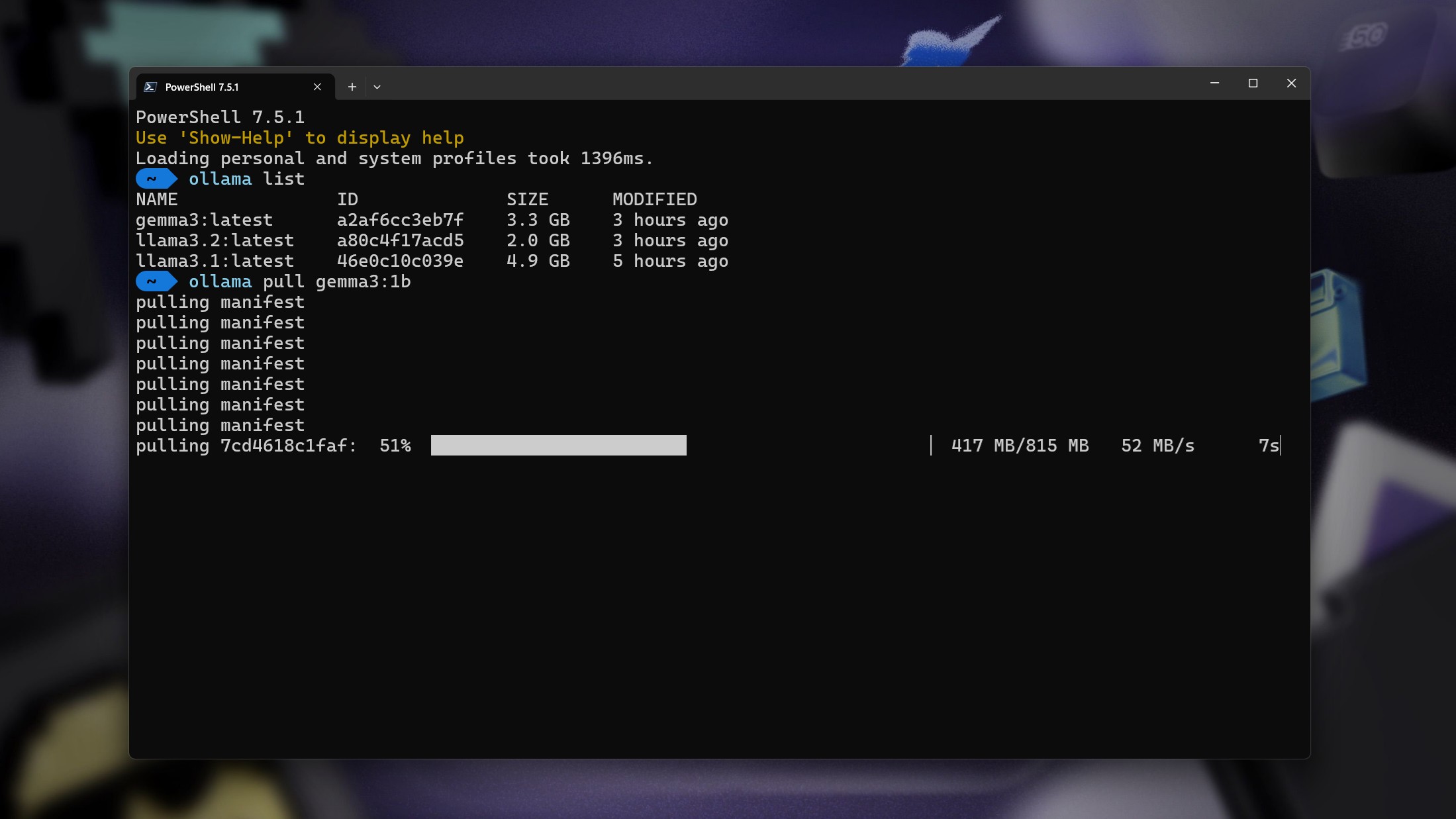

Ollamaに現在インストールされていないLLMモデルを実行させると、まず自動的にダウンロードしてから実行します。インストールしたい大規模言語モデルの正しい名前は、以下のリンクから簡単に見つけることができます。 オラマのウェブサイト.

たとえば、3 億パラメータの Google Gemma 1 LLM モデルをインストールして実行するには、次のコマンドを入力します。

オラマランジェマ:1b

追加することに注意してください :1b 名前の後に、1億個のパラメータを持つモデルが必要であることを指定します。4億個のパラメータを持つモデルが必要な場合は、**:4b** に変更します。

ターミナルでフォームを実行すると、使い慣れたチャットボット エクスペリエンスが開き、プロンプトを記述して応答を受け取ることができます。これらはすべてデバイス上でローカルに実行されます。

フォームを終了して PowerShell に戻るには、「**/bye**」と入力するだけでプロセスが終了します。

OllamaをコンピュータにインストールしてLLMスイートを使用するための基本的な手順を網羅しています。基本的な操作は非常にシンプルで使いやすく、セットアップに技術的な知識はほとんど必要ありません。私にできるのなら、あなたにもできるはずです!

コメントは締め切りました。