最新の大規模言語モデル(LLM)をMacにローカルにインストールする方法

近年、大規模言語モデル(LLM)は、人間のようなテキストを生成し、様々なタスクを支援する能力により、ますます人気が高まっています。すべてのモデルがオープンソースではありませんが、ほぼすべての大手テクノロジー企業が、ユーザーがダウンロードして実行できるバージョンを提供しています。

これらのモデルをMacでローカルに実行することは、プライバシーとコストの両方の面でメリットがあります。この記事では、LLMをインストールして実行する方法について説明します。 オラマこれは開発者や初心者ユーザーにとって強力なツールであり、macOS ターミナルを使用したくないユーザーのためにプロセスを簡素化できるグラフィカル ユーザー インターフェイス ツールについてもいくつか説明します。

こうすることで、[Google]、[Microsoft]、[Meta]、および[Mistral]や[DeepSeek]などの他のAI企業の最新のAI搭載テキストテンプレートにアクセスできます。

LLM を理解する: パラメータは何を意味するのでしょうか?

インストール手順に入る前に、「7B「または」14BLLMの場合、これらの数字はモデルのサイズを表します。 先生たち (数十億単位)これらは本質的には、トレーニング中に正確に調整される「ハンドルとスイッチ」です。

パラメータの数が多いほど、モデルは言語のより複雑なパターンや関係性を捉えることができ、パフォーマンスが向上する可能性があります。ただし、パラメータの数が多いからといって必ずしも結果が良くなるわけではないことに注意が必要です。トレーニングデータの品質とモデルで利用可能な計算リソースも重要な役割を果たします。

システム要求

[Mac] が少なくとも以下の仕様を満たしていることを確認する必要があります。

- macOS 10.15以降(macOS 13以降を推奨)

- 少なくとも8GBのRAM(16GB以上を推奨)

- 10 GB の空きストレージ容量(最小モデルに必要な最小値。パラメータ数が最大となるより高度なモデルでは約 700 GB 必要)

- [Intel] マルチコアプロセッサまたは [Apple Silicon] プロセッサ(M2 以上を推奨)

オラマをインストールする

オラマ これは、ローカルマシン上でLLMを直接実行できるオープンソースツールです。使い方は以下のとおりです。

- Ollamaをダウンロードウェブサイトをご覧ください: オラマ macOS版をダウンロードしてください。[Homebrew]を使ってインストールすることもできます。

brew install ollamaターミナルで。

- オラマをインストールするインストーラーをダウンロードした場合は、ダブルクリックしてセットアップウィザードに従ってください。Homebrewをご利用の場合は、手順4に進んでください。

- インストーラーの次のステップは、ボタンをクリックするだけです。 تثبيت管理者パスワードの入力が求められます。

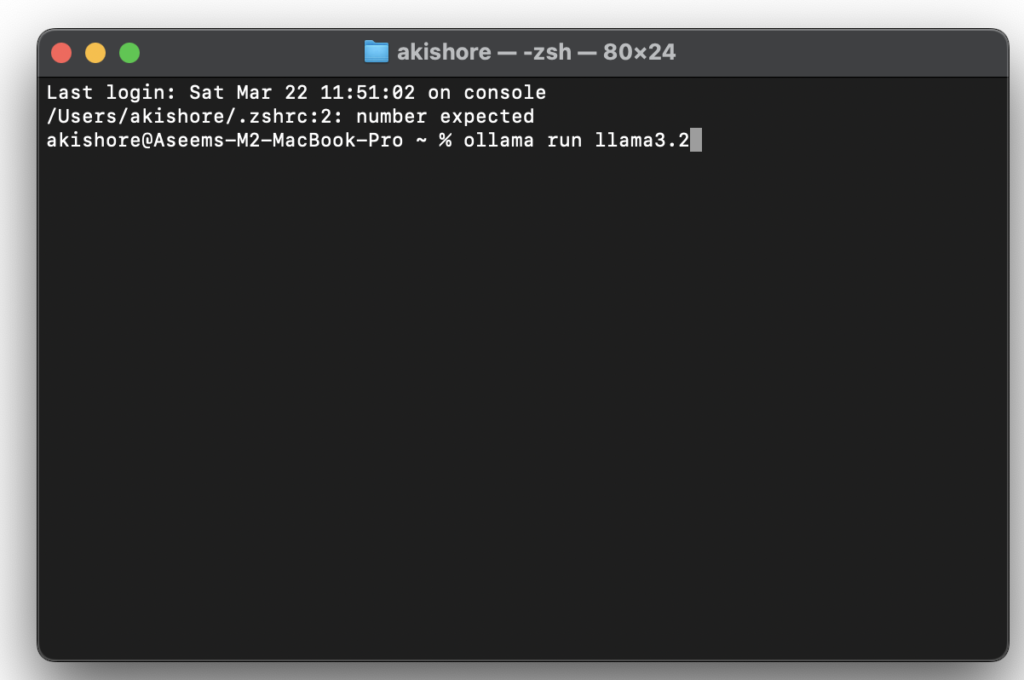

- ラン・オラマターミナルウィンドウを開き、コマンドを使用してOllamaをサービスとして起動します。

brew services start ollamaこれにより、Ollamaは次のアドレスで利用できるようになります。http://localhost:11434/. - モデルをダウンロードして実行するコマンドを使用する

ollama pull <model-name>テンプレートをダウンロードするには、コマンドollama run <model-name>実行するには、例えばモデルを実行するには ディープシーク-R1、コマンドを使用しますollama pull deepseek-r1注文に続いてollama run deepseek-r1. - テンプレートの拡大版をダウンロードするには、縦に2つのドットを追加し、その後にサイズを入力してください。例えば、テンプレートをダウンロードするには 14B ディープシークこのコマンドを使用します オルラマランディープシーク-r1:14bOllama の Web サイトでは、いずれかのフォームをクリックすると、各バージョンのさまざまなコマンドがすべて表示されます。

完全なリストは以下をご覧ください。 オラマモデル ここで、上記のように2番目のコマンドを使用することもできます。まだインストールされていない場合は、まずフォームを取得してから実行します。

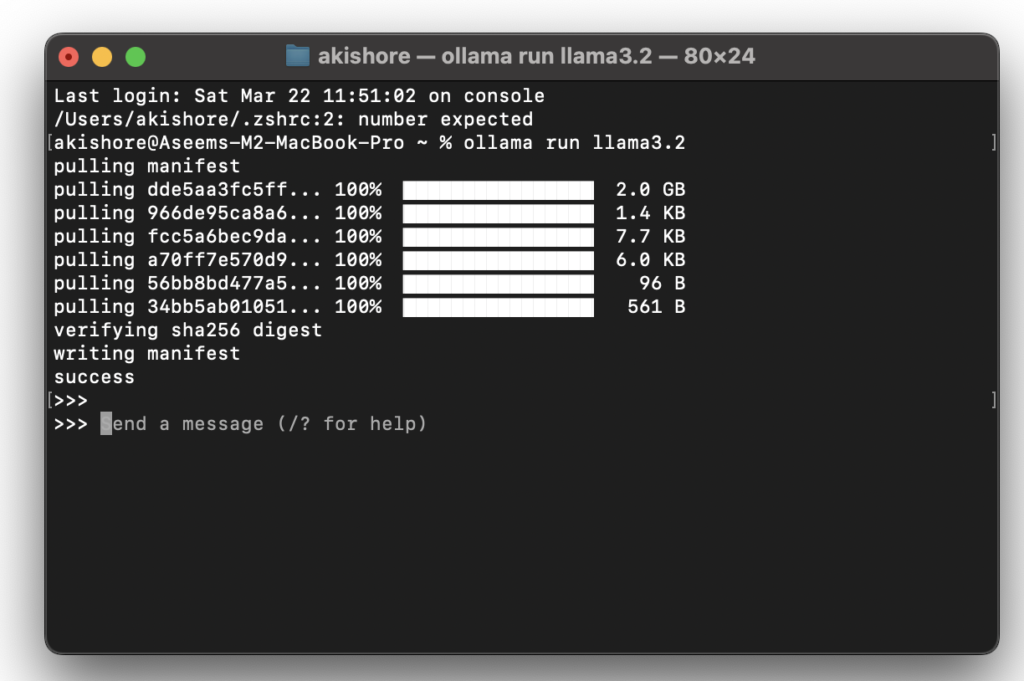

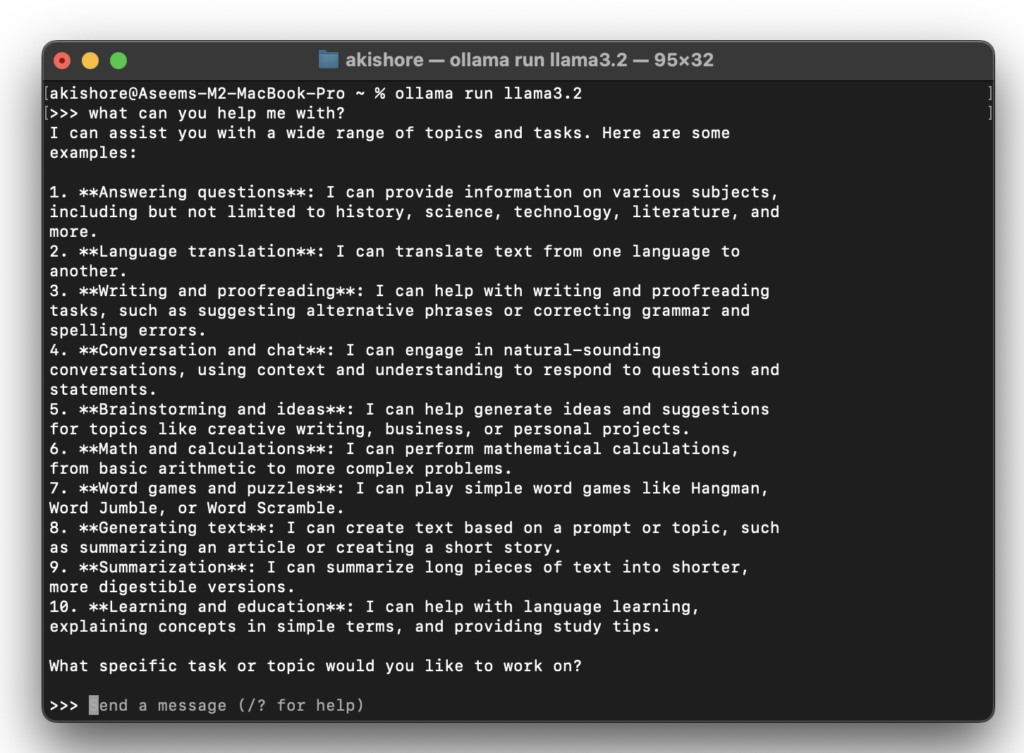

3 つの直角矢印 (>>>) が表示されたら、フォームにコマンドを入力し始めることができます。

これで完了です!これで、費用や過剰な利用、あるいは他人に自分の書いたものを読まれることを心配することなく、AI LLMとローカルでやり取りできるようになります。AI LLMとデリケートな話題や個人的な話題について話し合いたいけれど、大手テクノロジー企業に自分の考えを読まれたくない場合は、これは非常に便利です。

Ollama のグラフィカル ユーザー インターフェース ツールの使用

Ollamaは開発者にとって強力で効率的ですが、LLMの操作にはグラフィカルユーザーインターフェース(GUI)を好むユーザーもいます。OllamaのGUIフロントエンドを提供できるツールをいくつかご紹介します。

-

-

- オラマ GUIこれはmacOSユーザー向けの無料オープンソースアプリケーションで、SwiftUIを使用して構築されています。美しいインターフェースを備えており、ターミナルを使わずにローカルでLLMフォームにアクセスしたい方に最適です。

- オラマUIブラウザ内で直接フォームを定義し、操作できる、シンプルなHTMLベースのWebユーザーインターフェースです。Chrome拡張機能も付属しており、簡単にアクセスできます。

- チャットボックスAIこれは初心者にとって最も簡単なオプションです。使い方は以下で説明します。Chatbox AIサービスに加入する必要はありません。これはOllamaを自分でインストールしなくても、LLMテンプレートをすべて利用できるサブスクリプションです。

-

最高のチャットボックスAIインターフェースを使用するには、 ダウンロードページ お使いの Mac 専用のバージョンを入手してください。

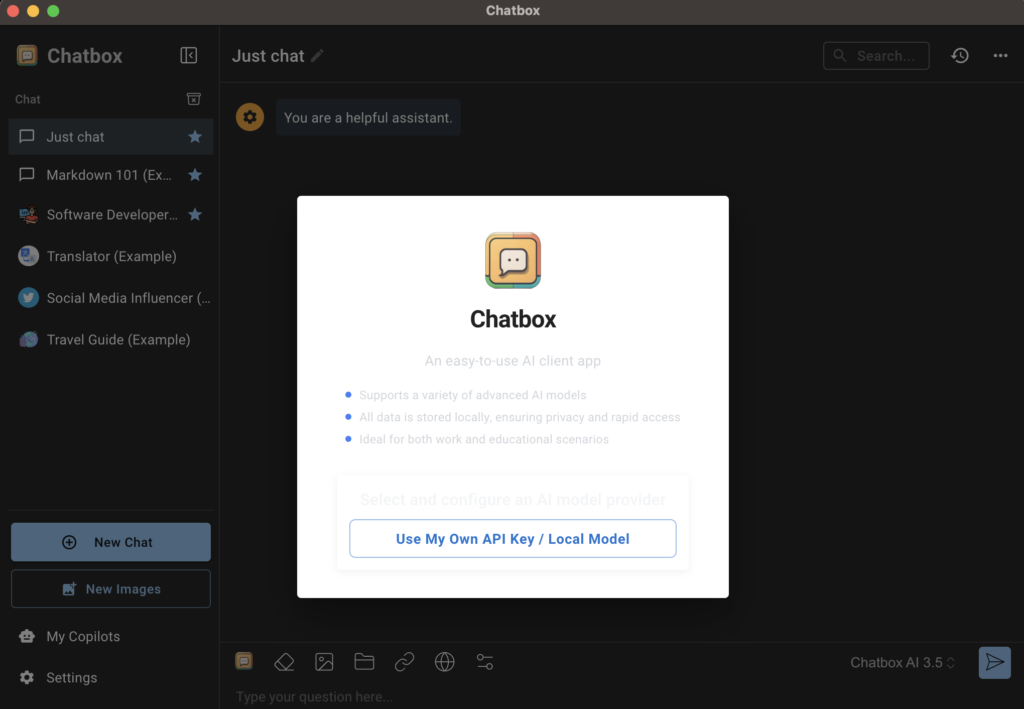

次に、インストーラーを開いてプログラムを実行します。最初の画面に、Chatbox AIの使い方を尋ねるポップアップウィンドウが表示されます。

ボタンをクリックする必要があります 独自のAPIキー/ローカルモデルを使用する.

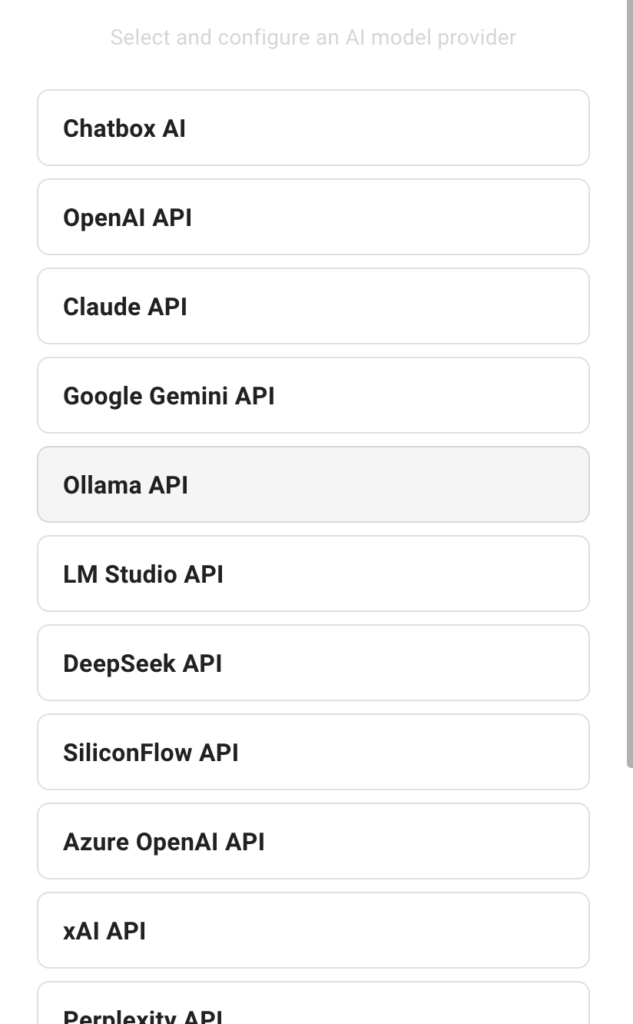

次に、をタップします オラマAPI 人工知能モデルのプロバイダーとして。

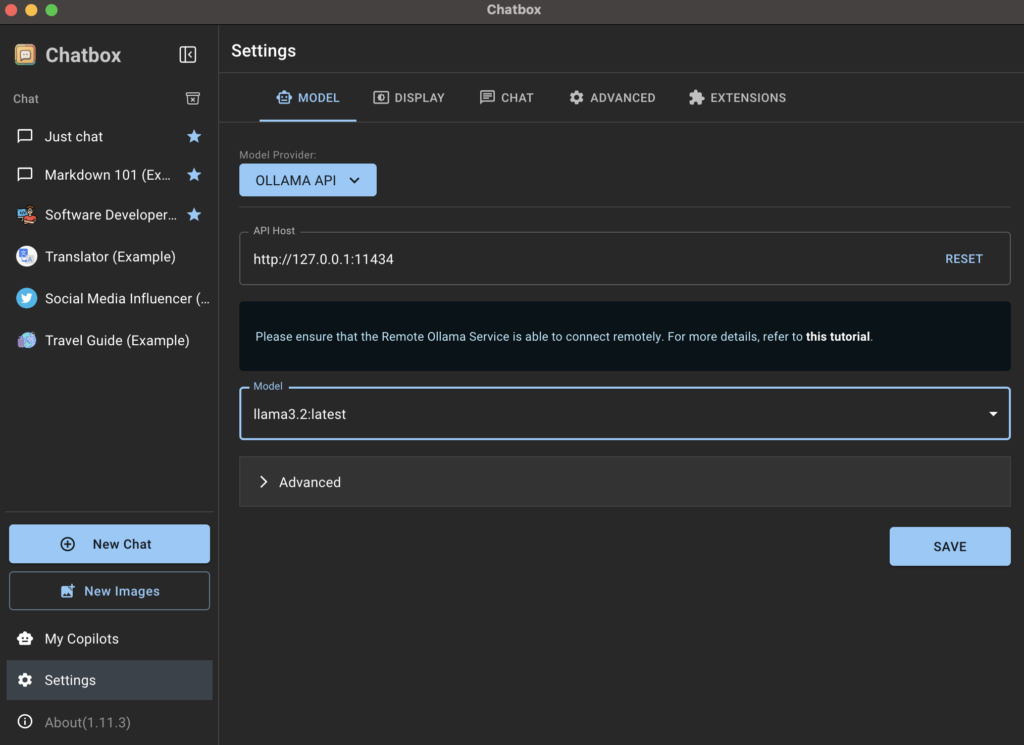

Chatbox AIはOllamaが動作していることを自動的に検出し、APIホストをデフォルト値に設定します。 ループバックIPアドレス とポート番号 11434ここでは何も変更する必要はありません。フォーム内に、ターミナルを使って以前にインストールしたフォームが表示されます。私の場合は、 ラマ3.2.

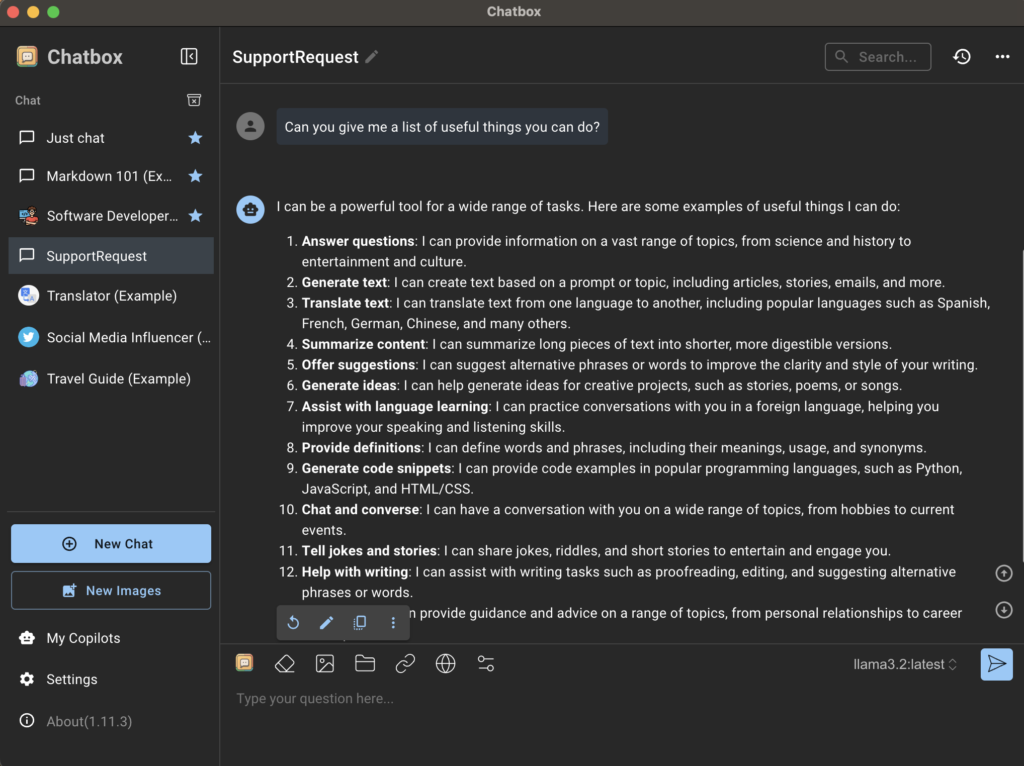

アプリのホームページに戻り、 チャットするだけ أو 新しいチャット 右下にある正しいテンプレートを選択してください。テンプレートはいつでも変更できますが、違いを簡単に確認できるように、使用するテンプレートごとに新しいチャットを作成することをお勧めします。

LLM モデルをローカルで実行するための代替ツール

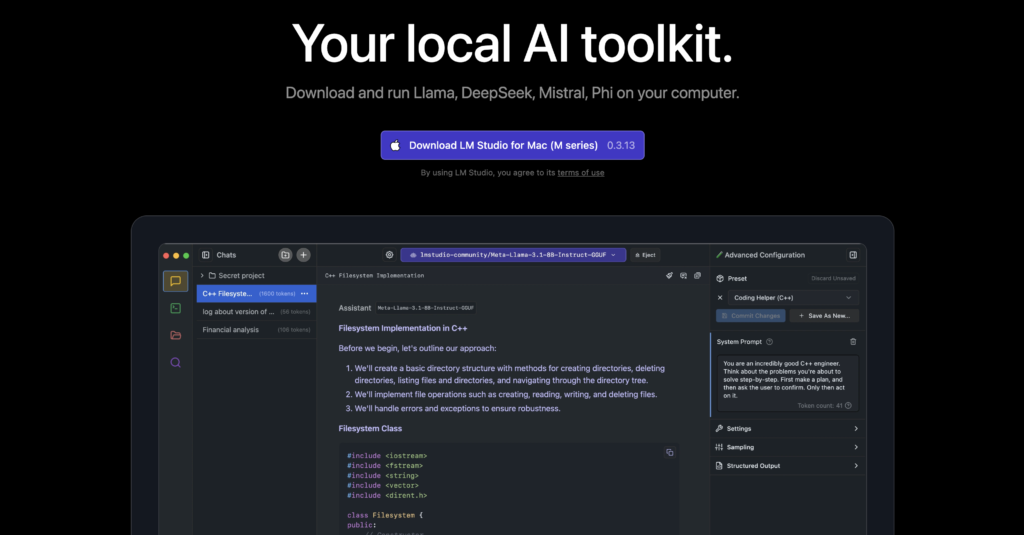

Ollamaの代替品を探している場合、または最初からよりユーザーフレンドリーな体験を好む場合は、 LMスタジオ これも優れた選択肢です。様々なAIモデルを探索・活用するためのユーザーフレンドリーなインターフェースを備えており、簡単にダウンロードして実行できます。LM StudioはLinux、Mac、Windowsで利用可能で、モデルパラメータのカスタマイズやチャット履歴などの機能を備えています。現在無料なので、Chatbox AIのサブスクリプションサービスよりもおすすめです。

結論

AIアプリケーションをより細かく制御し、データのプライバシーを最優先したいと考えている人にとって、Mac上で大規模言語モデル(LLM)をローカルに実行することは重要です。Ollamaのようなツールや、前述のグラフィカルフロントエンドを使えば、LLMをワークフローに簡単に統合できるため、生産性と創造性の新たな可能性を安全に解き放つことができます。

ただし、ローカルLLMの導入を開始するには、パラメータと、それらが特定のマシン上でこれらのモデルのパフォーマンスにどのように影響するかを理解する必要があります。これを理解する最良の方法は、さまざまなモデルを試してみて、どのモデルが最良の結果をもたらすかを確認することです。この概念を理解すれば、どのモデルを使用するか、そして特定のニーズに合わせてパフォーマンスを最適化する方法について、より適切な判断を下すことができるようになります。

コメントは締め切りました。