Microsoft Copilot で Anthropic Cloud AI を使用する方法

人工知能(AI)技術は急速に進化しており、Microsoftは現在、Microsoft 365 CopilotのオプションモジュールとしてAnthropicのクラウドを提供しています。ビジネスユーザーにとってクラウドとは、管理者権限があれば特定のCopilot関連タスクに選択できることを意味します。

そのため、拡張推論や安全性を重視した応答といったClaudeの強みを活用できます。以下は、Copilot内でClaudeを有効化、管理、使用する方法について説明したガイドです。

概要

Claudeを選択可能な大規模言語モデル(LLM)として使用します Microsoft エージェントおよび研究者のタスク用の 365 Copilot および Copilot Studio。

- 人間モデルはMicrosoftが管理する環境外でホストされる場合があり、データ処理に関する独自の利用規約が適用されます。そのため、管理者の承認と注意が必要です。

始める前に – 管理者の必須チェックリスト

- Microsoft 365 管理者にアクセスします。 組織に対してサードパーティの Large Language Model (LLM) プロバイダーを承認できるのは管理者のみです。

- 法的承認とコンプライアンス。 人間モデルは、Microsoft の直接的な管理外でデータを処理する場合があります。また、データの処理、保持、および規制への影響については、セキュリティ チームまたはコンプライアンス チームとご相談ください。

- ライセンスとコストの認識。 組織の Copilot/Copilot Studio ライセンスと、Anthropic モデルの使用に関する追加コストや料金を確認してください。

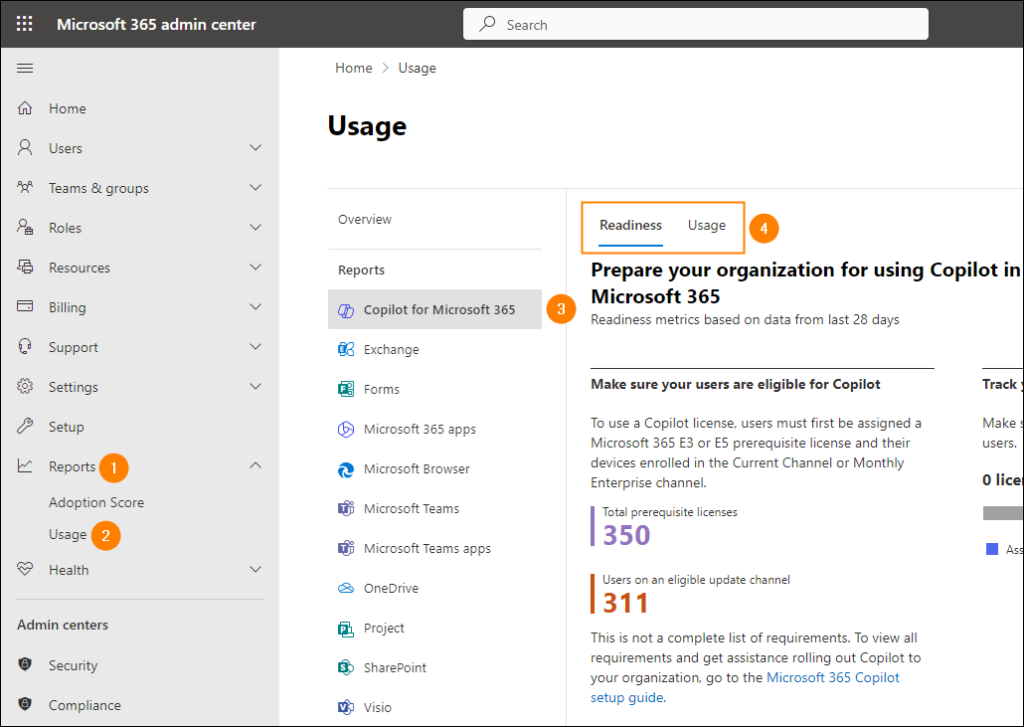

管理者: Microsoft 365 管理センターで Anthropic を有効にする

出典: Claudecom

- にサインイン Microsoft365管理センター.

- انن<XNUMXxDXNUMX><XNUMXxDXNUMX><XNUMXxDXNUMX><XNUMXxXNUMX>لل<XNUMXxDXNUMX><XNUMXxDXNUMX><XNUMXxDXNUMX><XNUMXxAXNUMX> コパイロット → 設定 → データアクセス (または「AI モデルへの接続」領域)。

- 以内に LLMは組織に提供します、検索 人間原理 プロバイダーを許可してください。提示される利用規約に同意する必要があります。接続を保存した後、完了するまでに数時間かかる場合があります。

コンテンツの説明: テナント レベルでの有効化はゲートウェイであり、管理者が許可するまで Claude は表示されません。

ガバナンスとデータ制御の構成

- アクセス範囲 組織単位またはセキュリティ グループに応じて次のようになります。 完全配布前に、Anthropic へのアクセスを実験チーム (製品や研究など) に制限します。

- データ処理ポリシー: 許可されるデータの種類(明示的に許可されない限り、保護対象の医療情報や機密性の高い決済カードデータは不可)と、文書化されたコンテンツがAnthropic環境に流入可能かどうかを文書化します。この文書では以下の点について説明しています… Microsoft Anthropic モデルは外部でホストされており、監査目的でこれを記録していることは明らかです。

- 監視記録とテレメトリ: サードパーティのフォームに送信されたコンテンツを追跡できるように、Copilot 使用ログと DLP (データ損失防止) ルールがアクティブになっていることを確認します。

ビジネス ユーザーは Copilot 内でどのように Claude を選択するのでしょうか?

組織が許可し、Anthropic がそれを有効にすると、次の操作を実行できます。

- アプリを検索する Microsoft 365 コパイロット または、Word、Excel、Outlook などのアプリケーション内で Copilot を開いたり、チャットしたりすることもできます。

- Copilotで選択 研究者 または選択 副操縦士スタジオ エージェントを作成するときにオプションが表示されます クラウドを試す あるいは、Copilot Studioでモデルオプションを設定する際に、AnthropicのSonnet/Opusモデルを選択することもできます。 クラウドを試す または必要なクラウド モデル。

助言: Researcher では、エージェントのクレームと必要なコンテキストを Anthropic モデルにルーティングして、出力をデフォルトの Microsoft モデルと比較できるようにする Claude を試してください。

最初にテストするための実用的なワークフロー

- 文書とメディアブリーフィングの要約: 使用する クロード 会議パッケージや長いレポートなどの長いコンテキスト要約用。

- 研究と供給: 研究者エージェントを介して比較文献レビューを実施したり、注釈付きの研究概要を編集したりします。

- 顧客の洞察: また、観察、テキスト、電子メールの件名などの大規模なデータセットを分析して傾向を明らかにします。

- 副操縦士エージェント: Copilot Studioでは、経費精算や設定支援などのタスクに特化したエージェントを作成できます。慎重な検討やセキュリティフィルターが必要なタスクには、Claudeを選択してください。

ビジネスユーザー向けの請求とやり取りに関するヒント

- コンテキストを明確にします。 さらに、関連文書、期限、希望する出力形式を明記してください。作業項目を3点にまとめたエグゼクティブサマリーも提出してください。

- リクエスト元: 実際の作業で Researcher を使用する場合は、引用または証拠の痕跡を要求します。

- 繰り返して記録します: 一部の機密性の高いワークフロー タスクでは、クレームの範囲を狭く保ち、修正されていない個人識別情報 (PII) を貼り付けないようにします。

- 出力を比較します。 さらに、実験するときは、デフォルトの Microsoft モデルとクラウドに対して同じプロンプトを実行し、どちらがタスクに最適かを確認します。

テスト、測定、拡張

- オンにする 小さな実験 (2~4 チーム) に 2 ~ 6 週間にわたって調査を実施し、定性的および定量的な観察結果を収集します。

- 精度、幻覚率、節約時間、ユーザー信頼スコア、データ損失防止 (DLP) インシデントの数などの指標を追跡します。

- 結果を使用してアクセスを拡張し、テンプレートを作成し、反復的なタスクの内部プロンプトを構築します。

セキュリティとコンプライアンスに関するリマインダー

- 人類学的モデルは組織のコンテンツを次のように処理します。 人間が宿主となる環境さらに、法務チームとプライバシーチームがこの移転を承認していることを確認します。

- 必要に応じて、管理者は後でテナント管理センターの同じデータ アクセス設定を使用して Anthropic をブロックできます。

結論: Copilot で Claude を試す理由は何でしょうか?

さらに、Anthropic のクラウドは、Microsoft の Copilot エコシステム内で代替モデル オプションを提供し、企業がモデルの長所をタスクに適合させることを可能にします。

したがって、適切な管理、慎重な経験、明確なユーザー ガイダンスがあれば、Claude は Copilot ツールキットへの強力な追加機能となることができます。

正式な管理者設定と詳細な手順については、Microsoft の Copilot Administrator ドキュメントと Anthropic Ads の出版物を参照してください。

コメントは締め切りました。